最新刊期

2022 年 第 27 卷 第 3 期

-

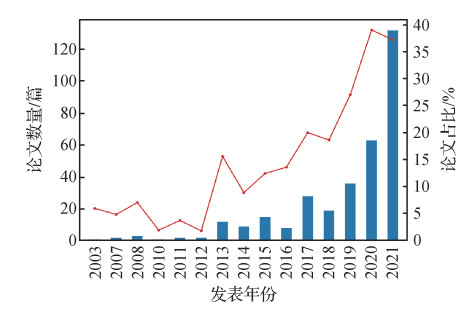

摘要:在过去20年里,医学影像技术、人工智能技术以及这两项技术相结合的临床应用都取得了长足发展。中国在该领域的研究也取得卓越成就,并且在全世界范围内的贡献比例仍在逐步提高。为了记录和总结国内同行的科研成果,本文对中国医学影像人工智能过去20年的发展历程进行回顾和展望。重点分析了国内同行在公认的医学影像人工智能领域的国际顶级刊物Medical Image Analysis(MedIA)和IEEE Transactions on Medical Imaging(TMI)以及顶级会议Medical Image Computing and Computer Assisted Intervention(MICCAI)发表的论文,定量统计了论文发表数量、作者身份、发表单位、作者合作链、关键词和被引次数等信息。同时总结了近20年中国医学影像人工智能发展进程中的重要事件,包括举办的医学影像人工智能知名国际和国内会议、《中国医学影像AI白皮书》的发布以及国内同行在COVID-19(corona virus disease 2019)期间的贡献,最后展望了中国医学影像人工智能领域未来的发展趋势。上述统计结果系统性地反映了在过去20年里中国在医学影像人工智能领域所取得的突出成绩。许多研究论文的作者将数据和源代码公开给全世界共享,为全世界医学影像人工智能的科研和教学做出了杰出贡献。通过本文中国医学影像人工智能领域的发展历程,可为医学影像人工智能同行,尤其为新一代的学者和学生提供科研和教学参考,也为继续促进和加强国际合作交流,为全世界该领域进一步的蓬勃发展做出重要贡献。关键词:医学影像;人工智能(AI);发展历程;国际合作;定量统计399|718|6更新时间:2024-05-07

摘要:在过去20年里,医学影像技术、人工智能技术以及这两项技术相结合的临床应用都取得了长足发展。中国在该领域的研究也取得卓越成就,并且在全世界范围内的贡献比例仍在逐步提高。为了记录和总结国内同行的科研成果,本文对中国医学影像人工智能过去20年的发展历程进行回顾和展望。重点分析了国内同行在公认的医学影像人工智能领域的国际顶级刊物Medical Image Analysis(MedIA)和IEEE Transactions on Medical Imaging(TMI)以及顶级会议Medical Image Computing and Computer Assisted Intervention(MICCAI)发表的论文,定量统计了论文发表数量、作者身份、发表单位、作者合作链、关键词和被引次数等信息。同时总结了近20年中国医学影像人工智能发展进程中的重要事件,包括举办的医学影像人工智能知名国际和国内会议、《中国医学影像AI白皮书》的发布以及国内同行在COVID-19(corona virus disease 2019)期间的贡献,最后展望了中国医学影像人工智能领域未来的发展趋势。上述统计结果系统性地反映了在过去20年里中国在医学影像人工智能领域所取得的突出成绩。许多研究论文的作者将数据和源代码公开给全世界共享,为全世界医学影像人工智能的科研和教学做出了杰出贡献。通过本文中国医学影像人工智能领域的发展历程,可为医学影像人工智能同行,尤其为新一代的学者和学生提供科研和教学参考,也为继续促进和加强国际合作交流,为全世界该领域进一步的蓬勃发展做出重要贡献。关键词:医学影像;人工智能(AI);发展历程;国际合作;定量统计399|718|6更新时间:2024-05-07 -

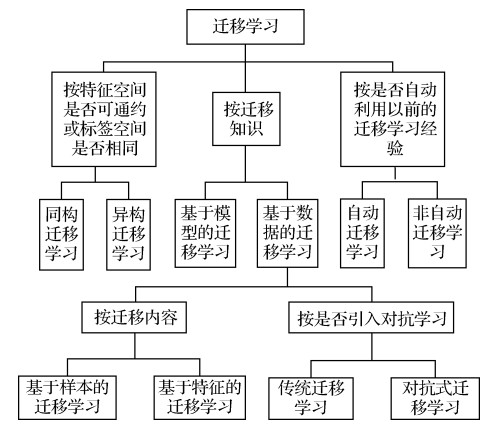

摘要:医学影像作为医疗数据的主要载体,在疾病预防、诊断和治疗中发挥着重要作用。医学图像分类是医学影像分析的重要组成部分。如何提高医学图像分类效率是一个持续的研究问题。随着计算机技术进步,医学图像分类方法已经从传统方法转到深度学习,再到目前热门的迁移学习。虽然迁移学习在医学图像分类中得到较广泛应用,但存在不少问题,本文对该领域的迁移学习应用情况进行综述,从中总结经验和发现问题,为未来研究提供线索。1)对基于迁移学习的医学图像分类研究的重要文献进行梳理、分析和总结,概括出3种迁移学习策略,即迁移模型的结构调整策略、参数调整策略和从迁移模型中提取特征的策略;2)从各文献研究设计的迁移学习过程中提炼共性,总结为5种迁移学习模式,即深度卷积神经网络(deep convolution neural network,DCNN)模式、混合模式、特征组合分类模式、多分类器融合模式和二次迁移模式。阐述了迁移学习策略和迁移学习模式之间的关系。这些迁移学习策略和模式有助于从更高的抽象层次展现迁移学习应用于医学图像分类领域的情况;3)阐述这些迁移学习策略和模式在医学图像分类中的具体应用,分析这些策略及模式的优点、局限性及适用场景;4)给出迁移学习在医学图像分类应用中存在的问题并展望未来研究方向。关键词:医学图像;图像分类;迁移学习;迁移学习策略;迁移学习模式333|404|13更新时间:2024-05-07

摘要:医学影像作为医疗数据的主要载体,在疾病预防、诊断和治疗中发挥着重要作用。医学图像分类是医学影像分析的重要组成部分。如何提高医学图像分类效率是一个持续的研究问题。随着计算机技术进步,医学图像分类方法已经从传统方法转到深度学习,再到目前热门的迁移学习。虽然迁移学习在医学图像分类中得到较广泛应用,但存在不少问题,本文对该领域的迁移学习应用情况进行综述,从中总结经验和发现问题,为未来研究提供线索。1)对基于迁移学习的医学图像分类研究的重要文献进行梳理、分析和总结,概括出3种迁移学习策略,即迁移模型的结构调整策略、参数调整策略和从迁移模型中提取特征的策略;2)从各文献研究设计的迁移学习过程中提炼共性,总结为5种迁移学习模式,即深度卷积神经网络(deep convolution neural network,DCNN)模式、混合模式、特征组合分类模式、多分类器融合模式和二次迁移模式。阐述了迁移学习策略和迁移学习模式之间的关系。这些迁移学习策略和模式有助于从更高的抽象层次展现迁移学习应用于医学图像分类领域的情况;3)阐述这些迁移学习策略和模式在医学图像分类中的具体应用,分析这些策略及模式的优点、局限性及适用场景;4)给出迁移学习在医学图像分类应用中存在的问题并展望未来研究方向。关键词:医学图像;图像分类;迁移学习;迁移学习策略;迁移学习模式333|404|13更新时间:2024-05-07 -

摘要:生成对抗式网络(generative adversarial network,GAN)由负责学习数据分布的生成器和负责鉴别样本真伪的判别器构成,二者在相互对抗过程中互相学习逐渐变强。该网络模型使深度学习方法可以自动学习损失函数,减少了对专家知识的依赖,已经广泛应用于自然图像处理领域,对解决医学影像处理的相关瓶颈问题亦具有巨大应用前景。本文旨在找到生成对抗式网络与医学影像领域面临挑战的结合点,通过分析已有工作对未来研究方向进行展望,为该领域研究提供参考。1)阐述了生成对抗式网络的基本原理,从任务拆分、条件约束以及图像到图像的翻译等角度对其衍生模型进行分析回顾;2)对生成对抗式网络在医学影像领域中的数据增广、模态迁移、图像分割以及去噪等方面的应用进行回顾,分析各方法的优缺点与适用范围;3)对现有图像生成质量评估方法进行小结;4)总结生成对抗式网络在医学影像领域的研究进展,并结合该领域问题特性,指出现有理论应用存在的不足与改进方向。生成对抗式网络提出以来,理论不断完善,在医学影像的处理应用中也取得了长足发展,但仍然存在一些亟待解决的问题,包括3维数据合成、几何结构合理性保持、无标记和未配对数据使用以及多模态数据交叉应用等。关键词:生成对抗式网络(GAN);医学影像;深度学习;数据增广;模态迁移;图像分割;图像去噪192|253|2更新时间:2024-05-07

摘要:生成对抗式网络(generative adversarial network,GAN)由负责学习数据分布的生成器和负责鉴别样本真伪的判别器构成,二者在相互对抗过程中互相学习逐渐变强。该网络模型使深度学习方法可以自动学习损失函数,减少了对专家知识的依赖,已经广泛应用于自然图像处理领域,对解决医学影像处理的相关瓶颈问题亦具有巨大应用前景。本文旨在找到生成对抗式网络与医学影像领域面临挑战的结合点,通过分析已有工作对未来研究方向进行展望,为该领域研究提供参考。1)阐述了生成对抗式网络的基本原理,从任务拆分、条件约束以及图像到图像的翻译等角度对其衍生模型进行分析回顾;2)对生成对抗式网络在医学影像领域中的数据增广、模态迁移、图像分割以及去噪等方面的应用进行回顾,分析各方法的优缺点与适用范围;3)对现有图像生成质量评估方法进行小结;4)总结生成对抗式网络在医学影像领域的研究进展,并结合该领域问题特性,指出现有理论应用存在的不足与改进方向。生成对抗式网络提出以来,理论不断完善,在医学影像的处理应用中也取得了长足发展,但仍然存在一些亟待解决的问题,包括3维数据合成、几何结构合理性保持、无标记和未配对数据使用以及多模态数据交叉应用等。关键词:生成对抗式网络(GAN);医学影像;深度学习;数据增广;模态迁移;图像分割;图像去噪192|253|2更新时间:2024-05-07 -

摘要:心脏为人体血液流动提供动力,是人体血液循环系统的重要组成部分。受人口老龄化影响,心脏病诊疗已成为重大公共健康话题。非侵入式活体心脏成像对心脏疾病的检测、诊断与治疗意义重大。然而,受活体心跳影响,成像扫描时间与心脏影像分辨率成为难以调和的矛盾。为缓和这一矛盾,基于快速扫描获得的低分辨率影像重建出心脏高分辨率影像的超分辨率(super-resolution, SR)重建技术成为研究热点。深度学习技术在医学影像处理领域中展现出强大生命力,基于深度学习的SR技术因其强大的学习能力与数据驱动性,在心脏影像SR重建领域中表现出明显优于传统方法的性能。目前领域内前沿成果较多,但缺少对领域现状进行总结、对未来发展进行展望的综述性文献。因此,本文对领域内现状进行梳理总结,挑选出代表性方法,分析方法特性,总结文献中心脏影像数据来源与规模,给出常用的评价指标,以及模型得出的性能评价结论。分析发现,基于深度学习的心脏SR重建技术取得了较大进展,但在运动伪影抑制、模型简化程度与时间性能方面仍有进步空间。此外,现有模型基本完全依靠网络强大的表达能力,鲜有临床先验知识的引入。最后,模型间性能对比相对较少,且领域内缺少代表性的可用于评价不同心脏SR重建模型性能的数据集。基于深度学习的心脏影像SR技术仍有较大发展空间。关键词:深度学习;心脏医学影像;超分辨率重建;磁共振成像;心脏影像数据集;卷积神经网络;高分辨率影像242|1030|3更新时间:2024-05-07

摘要:心脏为人体血液流动提供动力,是人体血液循环系统的重要组成部分。受人口老龄化影响,心脏病诊疗已成为重大公共健康话题。非侵入式活体心脏成像对心脏疾病的检测、诊断与治疗意义重大。然而,受活体心跳影响,成像扫描时间与心脏影像分辨率成为难以调和的矛盾。为缓和这一矛盾,基于快速扫描获得的低分辨率影像重建出心脏高分辨率影像的超分辨率(super-resolution, SR)重建技术成为研究热点。深度学习技术在医学影像处理领域中展现出强大生命力,基于深度学习的SR技术因其强大的学习能力与数据驱动性,在心脏影像SR重建领域中表现出明显优于传统方法的性能。目前领域内前沿成果较多,但缺少对领域现状进行总结、对未来发展进行展望的综述性文献。因此,本文对领域内现状进行梳理总结,挑选出代表性方法,分析方法特性,总结文献中心脏影像数据来源与规模,给出常用的评价指标,以及模型得出的性能评价结论。分析发现,基于深度学习的心脏SR重建技术取得了较大进展,但在运动伪影抑制、模型简化程度与时间性能方面仍有进步空间。此外,现有模型基本完全依靠网络强大的表达能力,鲜有临床先验知识的引入。最后,模型间性能对比相对较少,且领域内缺少代表性的可用于评价不同心脏SR重建模型性能的数据集。基于深度学习的心脏影像SR技术仍有较大发展空间。关键词:深度学习;心脏医学影像;超分辨率重建;磁共振成像;心脏影像数据集;卷积神经网络;高分辨率影像242|1030|3更新时间:2024-05-07 -

摘要:计算机断层扫描(computed tomography,CT)技术能为新冠肺炎(corona virus disease 2019,COVID-19)和肺癌等肺部疾病的诊断与治疗提供更全面的信息,但是由于肺部疾病的类型多样且复杂,使得对肺CT图像进行高质量的肺病变区域分割成为计算机辅助诊断的重难点问题。为了对肺CT图像的肺及肺病变区域分割方法的现状进行全面研究,本文综述了近年国内外发表的相关文献:对基于区域和活动轮廓的肺CT图像传统分割方法的优缺点进行比较与总结,传统的肺CT图像分割方法因其实现原理简单且分割速度快等优点,早期使用较多,但其存在分割精度不高的缺点,目前仍有不少基于传统方法的改进策略;重点分析了基于卷积神经网络(convolutional neural network,CNN)、全卷积网络(fully convolutional network,FCN)、U-Net和生成对抗网络(generative adversarial network,GAN)的肺CT图像分割网络结构改进模型的研究进展,基于深度学习的分割方法具有分割精度高、迁移学习能力强和鲁棒性高等优点,特别是在辅助诊断COVID-19病例时,基于深度学习方法的性能明显优于基于传统方法的性能;介绍肺及肺病变区域分割的常用数据集和评价指标,在解决如COVID-19数据样本量少等问题时,使用GAN以合成高质量的对抗性图像用以扩充数据集,从而增加训练样本的数量和多样性;讨论了肺CT图像的肺及肺病变区域的高精度分割策略的研究趋势、现有挑战和未来的研究方向。关键词:计算机断层扫描(CT);医学图像分割;肺CT图像分割;肺病变区域;深度学习;新冠肺炎(COVID-19)280|226|4更新时间:2024-05-07

摘要:计算机断层扫描(computed tomography,CT)技术能为新冠肺炎(corona virus disease 2019,COVID-19)和肺癌等肺部疾病的诊断与治疗提供更全面的信息,但是由于肺部疾病的类型多样且复杂,使得对肺CT图像进行高质量的肺病变区域分割成为计算机辅助诊断的重难点问题。为了对肺CT图像的肺及肺病变区域分割方法的现状进行全面研究,本文综述了近年国内外发表的相关文献:对基于区域和活动轮廓的肺CT图像传统分割方法的优缺点进行比较与总结,传统的肺CT图像分割方法因其实现原理简单且分割速度快等优点,早期使用较多,但其存在分割精度不高的缺点,目前仍有不少基于传统方法的改进策略;重点分析了基于卷积神经网络(convolutional neural network,CNN)、全卷积网络(fully convolutional network,FCN)、U-Net和生成对抗网络(generative adversarial network,GAN)的肺CT图像分割网络结构改进模型的研究进展,基于深度学习的分割方法具有分割精度高、迁移学习能力强和鲁棒性高等优点,特别是在辅助诊断COVID-19病例时,基于深度学习方法的性能明显优于基于传统方法的性能;介绍肺及肺病变区域分割的常用数据集和评价指标,在解决如COVID-19数据样本量少等问题时,使用GAN以合成高质量的对抗性图像用以扩充数据集,从而增加训练样本的数量和多样性;讨论了肺CT图像的肺及肺病变区域的高精度分割策略的研究趋势、现有挑战和未来的研究方向。关键词:计算机断层扫描(CT);医学图像分割;肺CT图像分割;肺病变区域;深度学习;新冠肺炎(COVID-19)280|226|4更新时间:2024-05-07

综述

-

摘要:目的为辅助医生快速分辨新型冠状病毒肺炎(corona virus disease 2019, COVID-19)轻、重症患者,以便对症下药减轻医疗负担,提出一种基于结构图注意力网络的轻重症诊断算法。方法基于胸部CT图像提取的特定特征以及肺段间的位置关系构建结构图,以肺部内不同肺段为节点,以提取特征为节点属性。采用图神经网络汇聚相邻节点特征,再利用池化层获取分别代表左肺叶和右肺叶特征的图表示。使用结构注意力机制计算左、右肺叶的感染情况对结果诊断的重要性,并依据重要性融合左、右肺叶图表示以得到最终图表示,最后执行分类任务。由于数据中存在明显的类别不平衡现象,采用Focal-Loss损失函数优化模型以减轻对分类结果的影响。结果实验将所提算法分别与传统机器学习方法和流行的图神经网络算法做性能对比。在重症诊断的准确率上,本文算法相较于传统机器学习方法和图神经网络算法分别取得14.2%~42.0%和3.6%~4.8%的提升。在AUC(area under curve)指标上,本文算法相较于上述两种算法分别取得8.9%~18.7%和3.1%~3.6%的提升。除此之外,通过消融实验发现具有结构注意力机制的算法相较于未使用的算法在SPE(specificity)、SEN(sensitivity)和AUC 3个指标上分别取得了2.4%、1.4%和1.1%的提升;应用Focal-Loss损失函数的算法相较于未使用的算法提升了2.1%、1.1%和0.9%。结论所提出的诊断模型综合了图神经网络以及结构注意力机制的优点,引入Focal-Loss损失函数,提升了困难样本的分类准确率,使诊断结果更加准确。关键词:新冠肺炎(COVID-19)诊断;图神经网络(GNN);结构注意力机制;拓扑结构图;图分类109|229|2更新时间:2024-05-07

摘要:目的为辅助医生快速分辨新型冠状病毒肺炎(corona virus disease 2019, COVID-19)轻、重症患者,以便对症下药减轻医疗负担,提出一种基于结构图注意力网络的轻重症诊断算法。方法基于胸部CT图像提取的特定特征以及肺段间的位置关系构建结构图,以肺部内不同肺段为节点,以提取特征为节点属性。采用图神经网络汇聚相邻节点特征,再利用池化层获取分别代表左肺叶和右肺叶特征的图表示。使用结构注意力机制计算左、右肺叶的感染情况对结果诊断的重要性,并依据重要性融合左、右肺叶图表示以得到最终图表示,最后执行分类任务。由于数据中存在明显的类别不平衡现象,采用Focal-Loss损失函数优化模型以减轻对分类结果的影响。结果实验将所提算法分别与传统机器学习方法和流行的图神经网络算法做性能对比。在重症诊断的准确率上,本文算法相较于传统机器学习方法和图神经网络算法分别取得14.2%~42.0%和3.6%~4.8%的提升。在AUC(area under curve)指标上,本文算法相较于上述两种算法分别取得8.9%~18.7%和3.1%~3.6%的提升。除此之外,通过消融实验发现具有结构注意力机制的算法相较于未使用的算法在SPE(specificity)、SEN(sensitivity)和AUC 3个指标上分别取得了2.4%、1.4%和1.1%的提升;应用Focal-Loss损失函数的算法相较于未使用的算法提升了2.1%、1.1%和0.9%。结论所提出的诊断模型综合了图神经网络以及结构注意力机制的优点,引入Focal-Loss损失函数,提升了困难样本的分类准确率,使诊断结果更加准确。关键词:新冠肺炎(COVID-19)诊断;图神经网络(GNN);结构注意力机制;拓扑结构图;图分类109|229|2更新时间:2024-05-07 -

摘要:目的肺内血管形态结构的改变是慢性阻塞性肺疾病(慢阻肺)的一种重要病理改变。针对慢阻肺中肺血管疾病的定量评估问题,提出一种基于各向异性连续最大流的肺内血管自动分割方法,并定量分析不同半径的肺内血管体积分布,以研究慢阻肺病程中肺血管重塑规律。方法使用U-Net分割肺体,获取肺脏区域,减少后续血管增强与分割的运算量;借助基于多尺度Hessian矩阵的血管增强方法,获得血管的似然增强结果和轴向方向;将血管似然结果和轴向信息以数据保真项和各向异性正则项的形式融入到连续最大流分割框架,实现肺血管的自动分割。结果在公开数据集ArteryVein和仿真数据集VascuSynth上对肺内血管分割方法的有效性进行测试;在从4家医院收集的614例临床影像数据上分析小半径血管体积占比情况,对比慢阻肺组与非慢阻肺组之间肺血管重塑差异。肺血管分割方面,对于增加不同程度的高斯噪声(σ=5,10,15,20,25,30,35)的VascuSynth仿真数据,本文方法获得的Dice值分别为0.87,0.80,0.77,0.75,0.73,0.71,0.69;对于低剂量数据集ArteryVein,Dice值为0.79。肺血管定量分析方面,非慢阻肺组和慢阻肺组的小血管体积平均占比值为0.656±0.067,0.589±0.074。不同慢阻肺分级GOLD1—4组小血管占比为0.612±0.051、0.600±0.078、0.565±0.067、0.528±0.053。结论本文提出的肺内血管算法可以用于肺血管重塑研究,通过实验分析验证了非慢阻肺组与慢阻肺组小血管体积占比存在显著差异;基于慢阻肺分级指数(global initiative for chronic obstructive pulmonary disease,GOLD)的不同慢阻肺病人之间,小血管体积占比在轻症和重症之间也存在显著差异。关键词:慢性阻塞性肺疾病(COPD);肺血管分割;各向异性总变分;连续最大流;定量分析182|130|0更新时间:2024-05-07

摘要:目的肺内血管形态结构的改变是慢性阻塞性肺疾病(慢阻肺)的一种重要病理改变。针对慢阻肺中肺血管疾病的定量评估问题,提出一种基于各向异性连续最大流的肺内血管自动分割方法,并定量分析不同半径的肺内血管体积分布,以研究慢阻肺病程中肺血管重塑规律。方法使用U-Net分割肺体,获取肺脏区域,减少后续血管增强与分割的运算量;借助基于多尺度Hessian矩阵的血管增强方法,获得血管的似然增强结果和轴向方向;将血管似然结果和轴向信息以数据保真项和各向异性正则项的形式融入到连续最大流分割框架,实现肺血管的自动分割。结果在公开数据集ArteryVein和仿真数据集VascuSynth上对肺内血管分割方法的有效性进行测试;在从4家医院收集的614例临床影像数据上分析小半径血管体积占比情况,对比慢阻肺组与非慢阻肺组之间肺血管重塑差异。肺血管分割方面,对于增加不同程度的高斯噪声(σ=5,10,15,20,25,30,35)的VascuSynth仿真数据,本文方法获得的Dice值分别为0.87,0.80,0.77,0.75,0.73,0.71,0.69;对于低剂量数据集ArteryVein,Dice值为0.79。肺血管定量分析方面,非慢阻肺组和慢阻肺组的小血管体积平均占比值为0.656±0.067,0.589±0.074。不同慢阻肺分级GOLD1—4组小血管占比为0.612±0.051、0.600±0.078、0.565±0.067、0.528±0.053。结论本文提出的肺内血管算法可以用于肺血管重塑研究,通过实验分析验证了非慢阻肺组与慢阻肺组小血管体积占比存在显著差异;基于慢阻肺分级指数(global initiative for chronic obstructive pulmonary disease,GOLD)的不同慢阻肺病人之间,小血管体积占比在轻症和重症之间也存在显著差异。关键词:慢性阻塞性肺疾病(COPD);肺血管分割;各向异性总变分;连续最大流;定量分析182|130|0更新时间:2024-05-07 -

摘要:目的清晰的胸部计算机断层扫描(computed tomography,CT)图像有助于医生准确诊断肺部相关疾病,但受成像设备、条件等因素的限制,扫描得到的CT图像质量有时会不尽如人意。因此,本文提出一种简单有效的基于基础信息保持和细节强化的胸部CT图像增强算法。方法利用多尺度引导滤波器将胸部CT图像分解为一个基础信息层和多个不同尺度的细节层。基于熵的权重将胸部CT图像的多个细节层进行融合,并乘以强化系数进一步增强纹理细节。将强化的细节层和原始的基础信息层重新组合即可生成细节强化的胸部CT图像。通过此种增强方式,本文算法既能显著增强胸部CT图像的纹理细节,又能将大部分原始的基础结构信息保留到增强图像中。结果为了验证算法的有效性,将本文算法与5种优秀的图像增强算法在由3 209幅胸部CT图像组成的数据集上进行测试评估。定性和定量实验结果表明,本文算法得到的增强图像保持了更多原始胸部CT图像中的基础结构信息,并更显著地强化了其中的纹理细节信息。在定量结果中,本文算法的标准差、结构相似性和峰值信噪比指标值均优于对比的5种方法,相比于性能第2的方法分别提高了4.95、0.16和4.47,即分别提升了5.61%、17.00%和16.17%。此外,本文算法增强一幅CT图像仅消耗0.10 s,有潜力应用于实际的临床诊断中。结论本文算法可以在保留大量原始结构信息的同时有效强化CT图像的细节信息,有助于医生对患者肺部疾病的精确诊断。本文算法具有较好的泛化能力,可以用于增强其他部位的CT图像和其他模态图像并取得优秀的增强结果。关键词:肺部疾病诊断;胸部CT图像增强;图像分解;基础信息保持;细节强化172|252|0更新时间:2024-05-07

摘要:目的清晰的胸部计算机断层扫描(computed tomography,CT)图像有助于医生准确诊断肺部相关疾病,但受成像设备、条件等因素的限制,扫描得到的CT图像质量有时会不尽如人意。因此,本文提出一种简单有效的基于基础信息保持和细节强化的胸部CT图像增强算法。方法利用多尺度引导滤波器将胸部CT图像分解为一个基础信息层和多个不同尺度的细节层。基于熵的权重将胸部CT图像的多个细节层进行融合,并乘以强化系数进一步增强纹理细节。将强化的细节层和原始的基础信息层重新组合即可生成细节强化的胸部CT图像。通过此种增强方式,本文算法既能显著增强胸部CT图像的纹理细节,又能将大部分原始的基础结构信息保留到增强图像中。结果为了验证算法的有效性,将本文算法与5种优秀的图像增强算法在由3 209幅胸部CT图像组成的数据集上进行测试评估。定性和定量实验结果表明,本文算法得到的增强图像保持了更多原始胸部CT图像中的基础结构信息,并更显著地强化了其中的纹理细节信息。在定量结果中,本文算法的标准差、结构相似性和峰值信噪比指标值均优于对比的5种方法,相比于性能第2的方法分别提高了4.95、0.16和4.47,即分别提升了5.61%、17.00%和16.17%。此外,本文算法增强一幅CT图像仅消耗0.10 s,有潜力应用于实际的临床诊断中。结论本文算法可以在保留大量原始结构信息的同时有效强化CT图像的细节信息,有助于医生对患者肺部疾病的精确诊断。本文算法具有较好的泛化能力,可以用于增强其他部位的CT图像和其他模态图像并取得优秀的增强结果。关键词:肺部疾病诊断;胸部CT图像增强;图像分解;基础信息保持;细节强化172|252|0更新时间:2024-05-07 -

摘要:目的股骨粗隆间骨折是老年人最常见的骨折,不同类型的骨折需要不同的治疗方法。计算机图像识别技术可以辅助医生提高诊断准确率。传统的图像特征提取和机器学习方法,无法实现细粒度、高精度的分类,且少见针对3维图像的骨折分型方法。基于深度学习方法,通常需要大量的样本参与训练才能得出较好的分型性能。针对上述问题,本文提出一种面向小样本、多分类的骨折分型方法。方法将原始CT(computed tomography)分层扫描图像进行3维重建,获取不同视角下的2维图像信息,利用添加注意力机制的多视角深度学习网络融合组合特征,并联合旋转网络获得视角不变特征,最终得到预期分型结果。结果针对自建训练数据集(5类,每类23个样本),实验在4种3维深度学习网络模型上进行比较。基于注意力机制的多视角融合深度学习方法比传统深度学习模型的准确率提高了25%;基于旋转网络的方法比多视角深度学习方法提高8%。通过对比实验表明,提出的多视角融合深度学习方法大大优于传统基于体素的方法,并且也有利于使网络快速收敛。结论在骨折分型中,本文提出的添加注意力机制的多视角融合分型方法优于传统基于体素的深度学习方法,具有更高的准确率和更好的性能。关键词:骨折分型;3维重建;多视角采样;多视角融合;注意力机制97|1464|0更新时间:2024-05-07

摘要:目的股骨粗隆间骨折是老年人最常见的骨折,不同类型的骨折需要不同的治疗方法。计算机图像识别技术可以辅助医生提高诊断准确率。传统的图像特征提取和机器学习方法,无法实现细粒度、高精度的分类,且少见针对3维图像的骨折分型方法。基于深度学习方法,通常需要大量的样本参与训练才能得出较好的分型性能。针对上述问题,本文提出一种面向小样本、多分类的骨折分型方法。方法将原始CT(computed tomography)分层扫描图像进行3维重建,获取不同视角下的2维图像信息,利用添加注意力机制的多视角深度学习网络融合组合特征,并联合旋转网络获得视角不变特征,最终得到预期分型结果。结果针对自建训练数据集(5类,每类23个样本),实验在4种3维深度学习网络模型上进行比较。基于注意力机制的多视角融合深度学习方法比传统深度学习模型的准确率提高了25%;基于旋转网络的方法比多视角深度学习方法提高8%。通过对比实验表明,提出的多视角融合深度学习方法大大优于传统基于体素的方法,并且也有利于使网络快速收敛。结论在骨折分型中,本文提出的添加注意力机制的多视角融合分型方法优于传统基于体素的深度学习方法,具有更高的准确率和更好的性能。关键词:骨折分型;3维重建;多视角采样;多视角融合;注意力机制97|1464|0更新时间:2024-05-07 -

摘要:目的肺结节检测在低剂量肺部计算机断层扫描(computed tomography,CT)筛查肺癌中具有重要意义。但由于结节大小、形状和密度的变化十分复杂,导致难以在低假阳性率下保证高的灵敏度,这限制了深度学习算法在常规临床实践中的肺结节自动诊断,建立具有良好结节检测性能的深度学习模型仍然是一个挑战。针对此问题,本文提出了一种基于3D ReSidual U(3D RSU)块的嵌套U结构的肺结节检测框架。方法3D RSU块通过混合不同大小的感受场获得多尺度特征来丰富特征信息。而嵌套U结构允许网络获得更大分辨率的特征图,从而具有多层次深度特征,获得丰富的局部和全局信息,增强网络区分前景和背景的能力,进而提高微小结节等非显著性目标的检测性能。结果该框架在公共肺结节(lung nodule analysis 16)挑战数据集上进行了评价。方法能够准确地检测出肺结节,灵敏度达到了97.2%,与基准方法相比,该方法灵敏度提高了2.6%,具有很高的灵敏度和特异性,在0.125、0.25、0.5、1、2、4、8共7个假阳率点的灵敏度平均值为86.4%,尤其是在每扫描0.25个假阳性上,灵敏度达到80.9%,优于基准算法76.9%的结果。结论本文所提出的结节检测模型,由于在低假阳率上有较高的灵敏度,可以使本网络在常规临床实践中为医生辅助诊断提供更加可靠清晰的早期肺癌参考信息。关键词:肺结节检测;嵌套结构;特征金字塔网络;非显著性目标检测;10折交叉验证87|271|2更新时间:2024-05-07

摘要:目的肺结节检测在低剂量肺部计算机断层扫描(computed tomography,CT)筛查肺癌中具有重要意义。但由于结节大小、形状和密度的变化十分复杂,导致难以在低假阳性率下保证高的灵敏度,这限制了深度学习算法在常规临床实践中的肺结节自动诊断,建立具有良好结节检测性能的深度学习模型仍然是一个挑战。针对此问题,本文提出了一种基于3D ReSidual U(3D RSU)块的嵌套U结构的肺结节检测框架。方法3D RSU块通过混合不同大小的感受场获得多尺度特征来丰富特征信息。而嵌套U结构允许网络获得更大分辨率的特征图,从而具有多层次深度特征,获得丰富的局部和全局信息,增强网络区分前景和背景的能力,进而提高微小结节等非显著性目标的检测性能。结果该框架在公共肺结节(lung nodule analysis 16)挑战数据集上进行了评价。方法能够准确地检测出肺结节,灵敏度达到了97.2%,与基准方法相比,该方法灵敏度提高了2.6%,具有很高的灵敏度和特异性,在0.125、0.25、0.5、1、2、4、8共7个假阳率点的灵敏度平均值为86.4%,尤其是在每扫描0.25个假阳性上,灵敏度达到80.9%,优于基准算法76.9%的结果。结论本文所提出的结节检测模型,由于在低假阳率上有较高的灵敏度,可以使本网络在常规临床实践中为医生辅助诊断提供更加可靠清晰的早期肺癌参考信息。关键词:肺结节检测;嵌套结构;特征金字塔网络;非显著性目标检测;10折交叉验证87|271|2更新时间:2024-05-07 -

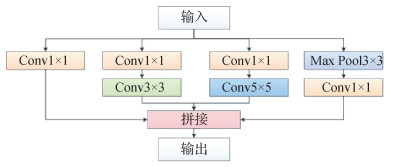

摘要:目的特发性肺纤维化(idiopathic pulmonary fibrosis,IPF)是一种致死率极高的肺间质疾病,呈渐进式发展且诊断手段有限,给病情的预后带来极大的困难。目前已有的肺功能衰退严重程度预测方法仍存在准确率较低的问题。方法提出了一种融合多尺度残差和注意力机制的特发性肺纤维化进展预测模型,包括计算机断层扫描(computed tomography,CT)特征提取网络和多模态特征预测网络,以此预测IPF患者不同周数的用力肺活量(forced vital capacity,FVC)。CT特征提取网络以InceptionV1为骨干网络,添加残差模块和改进的CBAM通道注意力模块(improved channel attention of convolutional block attention module,CBAM-ICA)来扩大网络的感受野,关注肺部区域的有效特征,添加与卷积层并行的空洞卷积模块,补充丢失的细节信息,并对改进的多尺度CT特征融合模块进行两次串联堆叠,提升网络获取CT特征的能力,最终获得更加有效的多尺度CT特征信息。多模态预测网络利用CT特征和临床特征进行融合形成的多模态特征对IPF患者不同周数的FVC值进行预测,提高了网络的预测性能。结果在OSIC(Open Source Imaging Consortium)提供的肺纤维化测试数据集上的实验结果表明,本文提出的特发性肺纤维化进展预测模型得到了-6.810 7的拉普拉斯对数似然得分,较其他方法具有更好的性能。结论提出的融合多尺度残差和注意力机制的特发性肺纤维化进展预测模型对预测IPF患者不同周数的FVC值具有一定的有效性,可以帮助医生更好地了解IPF患者肺功能衰退的严重程度,对IPF患者的预后具有指导意义。关键词:特发性肺纤维化(IPF);预测模型;多尺度残差;用力肺活量(FVC);注意力机制65|82|2更新时间:2024-05-07

摘要:目的特发性肺纤维化(idiopathic pulmonary fibrosis,IPF)是一种致死率极高的肺间质疾病,呈渐进式发展且诊断手段有限,给病情的预后带来极大的困难。目前已有的肺功能衰退严重程度预测方法仍存在准确率较低的问题。方法提出了一种融合多尺度残差和注意力机制的特发性肺纤维化进展预测模型,包括计算机断层扫描(computed tomography,CT)特征提取网络和多模态特征预测网络,以此预测IPF患者不同周数的用力肺活量(forced vital capacity,FVC)。CT特征提取网络以InceptionV1为骨干网络,添加残差模块和改进的CBAM通道注意力模块(improved channel attention of convolutional block attention module,CBAM-ICA)来扩大网络的感受野,关注肺部区域的有效特征,添加与卷积层并行的空洞卷积模块,补充丢失的细节信息,并对改进的多尺度CT特征融合模块进行两次串联堆叠,提升网络获取CT特征的能力,最终获得更加有效的多尺度CT特征信息。多模态预测网络利用CT特征和临床特征进行融合形成的多模态特征对IPF患者不同周数的FVC值进行预测,提高了网络的预测性能。结果在OSIC(Open Source Imaging Consortium)提供的肺纤维化测试数据集上的实验结果表明,本文提出的特发性肺纤维化进展预测模型得到了-6.810 7的拉普拉斯对数似然得分,较其他方法具有更好的性能。结论提出的融合多尺度残差和注意力机制的特发性肺纤维化进展预测模型对预测IPF患者不同周数的FVC值具有一定的有效性,可以帮助医生更好地了解IPF患者肺功能衰退的严重程度,对IPF患者的预后具有指导意义。关键词:特发性肺纤维化(IPF);预测模型;多尺度残差;用力肺活量(FVC);注意力机制65|82|2更新时间:2024-05-07 -

摘要:目的新型冠状病毒肺炎(corona virus disease 2019,COVID-19)患者肺部计算机断层扫描(computed tomography,CT)图像具有明显的病变特征,快速而准确地从患者肺部CT图像中分割出病灶部位,对COVID-19患者快速诊断和监护具有重要意义。COVID-19肺炎病灶区域复杂多变,现有方法分割精度不高,且对假阴性的关注不够,导致分割结果往往具有较高的特异度,但灵敏度却很低。方法本文提出了一个基于深度学习的多尺度编解码网络(MED-Net(multiscale encode decode network)),该网络采用资源利用率高、计算速度快的HarDNet68(harmonic densely connected network)作为主干,它主要由5个harmonic dense block(HDB)组成,首先通过5个空洞空间卷积池化金字塔(atrous spatial pyramid pooling,ASPP)对HarDNet68的第1个卷积层和第1、3、4、5个HDB提取多尺度特征。接着在并行解码器(paralleled partial decoder,PPD)基础上设计了一个多尺度的并行解码器(multiscale parallel partial decoder,MPPD),通过对3个不同感受野的分支进行解码,解决了编码器部分的信息丢失及小病灶分割困难等问题。为了提升CT图像分割精度,降低网络学习难度,网络加入了深度监督机制,配合多尺度解码器,增加了对假阴性的关注,从而提高模型的灵敏度。结果在COVID-19 CT segmentation数据集上对本文网络进行了测试。实验结果表明,MED-Net可以有效地应对数据集样本少,以及分割目标的纹理、尺寸和位置变异大等问题。在只有50幅训练图像和50幅测试图像的数据集上,分割结果的Dice系数为73.8%,灵敏度为77.7%,特异度为94.3%;与Inf-Net(lung infection segmentation deep network)网络相比,分别提升了8.21%、12.28%、7.76%。其中,Dice系数和灵敏度达到了目前基于该数据集相同划分方式的先进水平。结论本文网络提高了COVID-19肺炎CT图像分割精确度,有效解决了数据集的数据量少、小病灶分割难度大等问题,具有全自动分割COVID-19肺炎CT图像的能力。关键词:新型冠状病毒肺炎(COVID-19);CT图像分割;多尺度编解码;深度监督机制;小病灶分割105|238|2更新时间:2024-05-07

摘要:目的新型冠状病毒肺炎(corona virus disease 2019,COVID-19)患者肺部计算机断层扫描(computed tomography,CT)图像具有明显的病变特征,快速而准确地从患者肺部CT图像中分割出病灶部位,对COVID-19患者快速诊断和监护具有重要意义。COVID-19肺炎病灶区域复杂多变,现有方法分割精度不高,且对假阴性的关注不够,导致分割结果往往具有较高的特异度,但灵敏度却很低。方法本文提出了一个基于深度学习的多尺度编解码网络(MED-Net(multiscale encode decode network)),该网络采用资源利用率高、计算速度快的HarDNet68(harmonic densely connected network)作为主干,它主要由5个harmonic dense block(HDB)组成,首先通过5个空洞空间卷积池化金字塔(atrous spatial pyramid pooling,ASPP)对HarDNet68的第1个卷积层和第1、3、4、5个HDB提取多尺度特征。接着在并行解码器(paralleled partial decoder,PPD)基础上设计了一个多尺度的并行解码器(multiscale parallel partial decoder,MPPD),通过对3个不同感受野的分支进行解码,解决了编码器部分的信息丢失及小病灶分割困难等问题。为了提升CT图像分割精度,降低网络学习难度,网络加入了深度监督机制,配合多尺度解码器,增加了对假阴性的关注,从而提高模型的灵敏度。结果在COVID-19 CT segmentation数据集上对本文网络进行了测试。实验结果表明,MED-Net可以有效地应对数据集样本少,以及分割目标的纹理、尺寸和位置变异大等问题。在只有50幅训练图像和50幅测试图像的数据集上,分割结果的Dice系数为73.8%,灵敏度为77.7%,特异度为94.3%;与Inf-Net(lung infection segmentation deep network)网络相比,分别提升了8.21%、12.28%、7.76%。其中,Dice系数和灵敏度达到了目前基于该数据集相同划分方式的先进水平。结论本文网络提高了COVID-19肺炎CT图像分割精确度,有效解决了数据集的数据量少、小病灶分割难度大等问题,具有全自动分割COVID-19肺炎CT图像的能力。关键词:新型冠状病毒肺炎(COVID-19);CT图像分割;多尺度编解码;深度监督机制;小病灶分割105|238|2更新时间:2024-05-07 -

摘要:目的高效的肝肿瘤计算机断层扫描(computed tomography,CT)图像自动分割方法是临床实践的迫切需求,但由于肝肿瘤边界不清晰、体积相对较小且位置无规律,要求分割模型能够细致准确地发掘类间差异。对此,本文提出一种基于特征选择与残差融合的2D肝肿瘤分割模型,提高了2D模型在肝肿瘤分割任务中的表现。方法该模型通过注意力机制对U-Net瓶颈特征及跳跃链接进行优化,为符合肝肿瘤分割任务特点优化传统注意力模块进,提出以全局特征压缩操作(global feature squeeze,GFS)为基础的瓶颈特征选择模块,即全局特征选择模块(feature selection module,FS)和邻近特征选择模块(neighbor feature selection module,NFS)。跳跃链接先通过空间注意力模块(spatial attention module,SAM)进行特征重标定,再通过空间特征残差融合(spatial feature residual fusion module,SFRF)模块解决前后空间特征的语义不匹配问题,在保持低复杂度的同时使特征高效表达。结果在LiTS(liver tumor segmentation)公开数据集上进行组件消融测试并与当前方法进行对比测试,在肝脏及肝肿瘤分割任务中的平均Dice得分分别为96.2%和68.4%,与部分2.5D和3D模型的效果相当,比当前最佳的2D肝肿瘤分割模型平均Dice得分高0.8%。结论提出的FSF-U-Net(feature selection and residual fusion U-Net)模型通过改进的注意力机制与优化U-Net模型结构的方法,使2D肝肿瘤分割的结果更加准确。关键词:肝肿瘤自动分割;注意力机制;U-Net结构;特征选择;残差融合83|218|0更新时间:2024-05-07

摘要:目的高效的肝肿瘤计算机断层扫描(computed tomography,CT)图像自动分割方法是临床实践的迫切需求,但由于肝肿瘤边界不清晰、体积相对较小且位置无规律,要求分割模型能够细致准确地发掘类间差异。对此,本文提出一种基于特征选择与残差融合的2D肝肿瘤分割模型,提高了2D模型在肝肿瘤分割任务中的表现。方法该模型通过注意力机制对U-Net瓶颈特征及跳跃链接进行优化,为符合肝肿瘤分割任务特点优化传统注意力模块进,提出以全局特征压缩操作(global feature squeeze,GFS)为基础的瓶颈特征选择模块,即全局特征选择模块(feature selection module,FS)和邻近特征选择模块(neighbor feature selection module,NFS)。跳跃链接先通过空间注意力模块(spatial attention module,SAM)进行特征重标定,再通过空间特征残差融合(spatial feature residual fusion module,SFRF)模块解决前后空间特征的语义不匹配问题,在保持低复杂度的同时使特征高效表达。结果在LiTS(liver tumor segmentation)公开数据集上进行组件消融测试并与当前方法进行对比测试,在肝脏及肝肿瘤分割任务中的平均Dice得分分别为96.2%和68.4%,与部分2.5D和3D模型的效果相当,比当前最佳的2D肝肿瘤分割模型平均Dice得分高0.8%。结论提出的FSF-U-Net(feature selection and residual fusion U-Net)模型通过改进的注意力机制与优化U-Net模型结构的方法,使2D肝肿瘤分割的结果更加准确。关键词:肝肿瘤自动分割;注意力机制;U-Net结构;特征选择;残差融合83|218|0更新时间:2024-05-07

计算机断层扫描图像

-

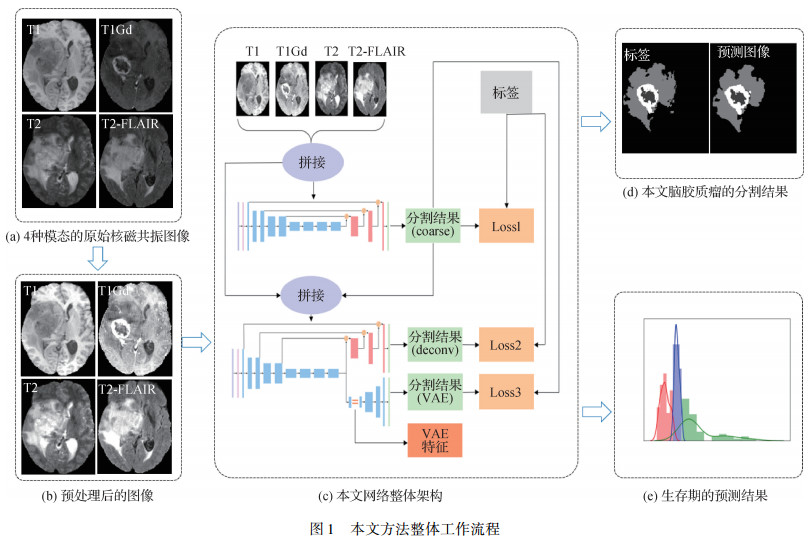

摘要:目的针对常见方法对脑胶质瘤的肿瘤分割和生存预测需要单独建模的问题,提出一种带有变分自编码器(variational auto-encoder, VAE)分支的两阶段级联U-Net算法,旨在分割肿瘤的同时提取鲁棒的特征预测患者生存期,有助于患者的精准治疗。方法提出的两阶段级联U-Net网络,第1阶段实现初步粗分割,第2阶段实现精细化分割。此外,在第2阶段添加变分自编码器分支以提取更加鲁棒的特征并提高模型泛化性。其中,变分自编码器分支获取的特征被送入随机森林算法以进行生存期预测。另外,在两个阶段的解码器部分都添加了SE(squeeze-and-excitation)-残差模块以及注意力门模块,提高了分割精度。结果在Brain Tumor Segmentation (BraTS)竞赛官网分别评估了本文方法在BraTS2020验证集上分割以及总体生存期预测两大任务的结果,本文算法在该验证集的全肿瘤区域、肿瘤核心区域以及增强型肿瘤区域分别取得了90.66%、85.09%和79.02%的Dice相似系数。相较3DU-Net在3个肿瘤子区域的Dice相似系数分别提高了4.3%、1.37%和5.36%。对于总体生存期的预测准确率达到了55.2%,相较性能最佳算法的预测准确率虽然低3.4%,但是从均方误差这一评估指标来看略有优势。结论为了防止出现过拟合,提出带有VAE分支的两阶段级联U-Net网络结构,同时该分支能够提取肿瘤的鲁棒特征用于后续生存分析。实验表明,该网络能够较为准确地分割脑肿瘤,并且其提取的特征能够准确地预测患者生存期,可以为临床医生进行脑胶质瘤诊断提供有力的参考。关键词:脑胶质瘤3维自动分割;生存期预测;级联神经网络;变分自编码器;注意力机制233|331|0更新时间:2024-05-07

摘要:目的针对常见方法对脑胶质瘤的肿瘤分割和生存预测需要单独建模的问题,提出一种带有变分自编码器(variational auto-encoder, VAE)分支的两阶段级联U-Net算法,旨在分割肿瘤的同时提取鲁棒的特征预测患者生存期,有助于患者的精准治疗。方法提出的两阶段级联U-Net网络,第1阶段实现初步粗分割,第2阶段实现精细化分割。此外,在第2阶段添加变分自编码器分支以提取更加鲁棒的特征并提高模型泛化性。其中,变分自编码器分支获取的特征被送入随机森林算法以进行生存期预测。另外,在两个阶段的解码器部分都添加了SE(squeeze-and-excitation)-残差模块以及注意力门模块,提高了分割精度。结果在Brain Tumor Segmentation (BraTS)竞赛官网分别评估了本文方法在BraTS2020验证集上分割以及总体生存期预测两大任务的结果,本文算法在该验证集的全肿瘤区域、肿瘤核心区域以及增强型肿瘤区域分别取得了90.66%、85.09%和79.02%的Dice相似系数。相较3DU-Net在3个肿瘤子区域的Dice相似系数分别提高了4.3%、1.37%和5.36%。对于总体生存期的预测准确率达到了55.2%,相较性能最佳算法的预测准确率虽然低3.4%,但是从均方误差这一评估指标来看略有优势。结论为了防止出现过拟合,提出带有VAE分支的两阶段级联U-Net网络结构,同时该分支能够提取肿瘤的鲁棒特征用于后续生存分析。实验表明,该网络能够较为准确地分割脑肿瘤,并且其提取的特征能够准确地预测患者生存期,可以为临床医生进行脑胶质瘤诊断提供有力的参考。关键词:脑胶质瘤3维自动分割;生存期预测;级联神经网络;变分自编码器;注意力机制233|331|0更新时间:2024-05-07 -

摘要:目的心脏磁共振成像(magnetic resonance imaging, MRI)的自动分割技术有利于在临床诊断中评估心脏的功能参数。然而由于心脏磁共振成像技术产生的图像边界不清晰、各向分辨率异性等特性,现有的大多数方法依旧存在类内不确定、类间不清晰问题。针对这一问题,提出了一种利用时间信息进行特征增强,并利用空间信息进行特征矫正的多输入、多分支和多任务的分割网络(spatio-temporal UNet,ST UNet)。方法为充分获取动态心脏MRI图像的时间信息,提出了全新的时间增强编码模块,将需要进行分割的目标帧和一段包含了目标帧的连续时间片段作为关键序列一同输入网络。关键序列用于获取更丰富的时间特征,目标帧提供更精准的边缘特征。为了聚集更多有益的特征,更好地融合时域特征和边缘特征,采用可变形全局连接代替传统的长连接,为网络的解码部分提供更广泛的多维特征信息。在训练过程中额外学习空间方向场特征,并使用该特征对原有的分割结果进行矫正。结果在ACDC(Automated Cardiac Diagnosis Challenge)心脏分割挑战中,以${\rm{Dice}}$系数和${\rm{HD}}$(Hausdorff distance)距离为评价指标,该方法在左心室、右心室和左心肌分割的平均${\rm{Dice}}$系数分别为95%、91.5%和91%,${\rm{HD}}$距离的平均值分别为6.77、11.39和8.54。结论实验表明,提出的新型网络能够充分地利用心脏MRI图像的时空信息,有效地提升目标器官的分割效果,更有助于医生对于心脏诊断。关键词:医学影像;心脏磁共振成像(CMRI);特征增强;空间方向场;U型网络(UNet)80|166|2更新时间:2024-05-07

摘要:目的心脏磁共振成像(magnetic resonance imaging, MRI)的自动分割技术有利于在临床诊断中评估心脏的功能参数。然而由于心脏磁共振成像技术产生的图像边界不清晰、各向分辨率异性等特性,现有的大多数方法依旧存在类内不确定、类间不清晰问题。针对这一问题,提出了一种利用时间信息进行特征增强,并利用空间信息进行特征矫正的多输入、多分支和多任务的分割网络(spatio-temporal UNet,ST UNet)。方法为充分获取动态心脏MRI图像的时间信息,提出了全新的时间增强编码模块,将需要进行分割的目标帧和一段包含了目标帧的连续时间片段作为关键序列一同输入网络。关键序列用于获取更丰富的时间特征,目标帧提供更精准的边缘特征。为了聚集更多有益的特征,更好地融合时域特征和边缘特征,采用可变形全局连接代替传统的长连接,为网络的解码部分提供更广泛的多维特征信息。在训练过程中额外学习空间方向场特征,并使用该特征对原有的分割结果进行矫正。结果在ACDC(Automated Cardiac Diagnosis Challenge)心脏分割挑战中,以${\rm{Dice}}$系数和${\rm{HD}}$(Hausdorff distance)距离为评价指标,该方法在左心室、右心室和左心肌分割的平均${\rm{Dice}}$系数分别为95%、91.5%和91%,${\rm{HD}}$距离的平均值分别为6.77、11.39和8.54。结论实验表明,提出的新型网络能够充分地利用心脏MRI图像的时空信息,有效地提升目标器官的分割效果,更有助于医生对于心脏诊断。关键词:医学影像;心脏磁共振成像(CMRI);特征增强;空间方向场;U型网络(UNet)80|166|2更新时间:2024-05-07 -

摘要:目的磁共振成像(magnetic resonance imaging,MRI)作为一种非侵入性的软组织对比成像方式,可以提供有关脑肿瘤的形状、大小和位置等有价值的信息,是用于脑肿瘤患者检查的主要方法,在脑肿瘤分割任务中发挥着重要作用。由于脑肿瘤本身复杂多变的形态、模糊的边界、低对比度以及样本梯度复杂等问题,导致高精度脑肿瘤MRI图像分割非常具有挑战性,目前主要依靠专业医师手动分割,费时且可重复性差。对此,本文提出一种基于U-Net的改进模型,即CSPU-Net(cross stage partial U-Net)脑肿瘤分割网络,以实现高精度的脑肿瘤MRI图像分割。方法CSPU-Net在U-Net结构的上下采样中分别加入两种跨阶段局部网络结构(cross stage partial module,${\rm{CSP}}$)提取图像特征,结合${\rm{GDL}}$(general Dice loss)和${\rm{WCE}}$(weighted cross entropy)两种损失函数解决训练样本类别不平衡问题。结果在BraTS (brain tumor segmentation) 2018和BraTS 2019两个数据集上进行实验,在BraTS 2018数据集中的整体肿瘤分割精度、核心肿瘤分割精度和增强肿瘤分割精度分别为87.9%、80.6%和77.3%,相比于传统U-Net的改进模型(ResU-Net)分别提升了0.80%、1.60%和2.20%。在BraTS 2019数据集中的整体肿瘤分割精度、核心肿瘤分割精度和增强肿瘤分割精度分别为87.8%、77.9%和70.7%,相比于ResU-Net模型提升了0.70%、1.30%和1.40%。结论本文提出的跨阶段局部网络结构,通过增加梯度路径、减少信息损失,可以有效提高脑肿瘤分割精度,实验结果证明了该模块对脑肿瘤分割任务的有效性。关键词:脑肿瘤分割;深度学习;U-Net;跨阶段局部网络结构;残差模块147|346|5更新时间:2024-05-07

摘要:目的磁共振成像(magnetic resonance imaging,MRI)作为一种非侵入性的软组织对比成像方式,可以提供有关脑肿瘤的形状、大小和位置等有价值的信息,是用于脑肿瘤患者检查的主要方法,在脑肿瘤分割任务中发挥着重要作用。由于脑肿瘤本身复杂多变的形态、模糊的边界、低对比度以及样本梯度复杂等问题,导致高精度脑肿瘤MRI图像分割非常具有挑战性,目前主要依靠专业医师手动分割,费时且可重复性差。对此,本文提出一种基于U-Net的改进模型,即CSPU-Net(cross stage partial U-Net)脑肿瘤分割网络,以实现高精度的脑肿瘤MRI图像分割。方法CSPU-Net在U-Net结构的上下采样中分别加入两种跨阶段局部网络结构(cross stage partial module,${\rm{CSP}}$)提取图像特征,结合${\rm{GDL}}$(general Dice loss)和${\rm{WCE}}$(weighted cross entropy)两种损失函数解决训练样本类别不平衡问题。结果在BraTS (brain tumor segmentation) 2018和BraTS 2019两个数据集上进行实验,在BraTS 2018数据集中的整体肿瘤分割精度、核心肿瘤分割精度和增强肿瘤分割精度分别为87.9%、80.6%和77.3%,相比于传统U-Net的改进模型(ResU-Net)分别提升了0.80%、1.60%和2.20%。在BraTS 2019数据集中的整体肿瘤分割精度、核心肿瘤分割精度和增强肿瘤分割精度分别为87.8%、77.9%和70.7%,相比于ResU-Net模型提升了0.70%、1.30%和1.40%。结论本文提出的跨阶段局部网络结构,通过增加梯度路径、减少信息损失,可以有效提高脑肿瘤分割精度,实验结果证明了该模块对脑肿瘤分割任务的有效性。关键词:脑肿瘤分割;深度学习;U-Net;跨阶段局部网络结构;残差模块147|346|5更新时间:2024-05-07 -

摘要:目的阿尔茨海默症(Alzheimer's disease,AD)是主要的老年病之一,并正向年轻化发展。早期通过核磁共振(magnetic resonance imaging,MRI)图像识别AD的发病阶段,有助于在AD初期及时采取相关干预措施和治疗手段,控制和延缓AD疾病恶化。为此,提出了基于平滑函数的组L1/2稀疏正则化(smooth group L1/2,${\rm{SGL}}$1/2)方法。方法通过引入平滑组L1/2正则化实现组内稀疏,并将原先组L1/2方法中含有的非平滑的绝对值函数向平滑函数逼近,解决了组L1/2方法中数值计算振荡和收敛难的缺点。${\rm{SGL}}$1/2方法能够在保持分类精度的前提下,加速对模型的求解。同时在分类方法中,引入一个校准hinge函数(calibrated hinge,${\rm{Chinge}}$)代替标准支持向量机(support vector machine,SVM)中的hinge函数,形成校准SVM(calibrated SVM,C-SVM)用于疾病的分类,使处于分类平面附近的样本更倾向于分类的正确一侧,对一些难以区分的样本能够进行更好的分类。结果与其他组级别上的正则化方法相比,${\rm{SGL}}$1/2与校准支持向量机结合的分类模型对AD的识别具有更高的分类性能,分类准确率高达94.70%。结论本文提出的组稀疏分类模型,实现了组间稀疏和组内稀疏的优点,为未来AD的自动诊断提供了客观参照。关键词:阿尔茨海默症(AD);组L1/2稀疏正则化;校准支持向量机(C-SVM);结构化磁共振;组间稀疏;组内稀疏60|132|0更新时间:2024-05-07

摘要:目的阿尔茨海默症(Alzheimer's disease,AD)是主要的老年病之一,并正向年轻化发展。早期通过核磁共振(magnetic resonance imaging,MRI)图像识别AD的发病阶段,有助于在AD初期及时采取相关干预措施和治疗手段,控制和延缓AD疾病恶化。为此,提出了基于平滑函数的组L1/2稀疏正则化(smooth group L1/2,${\rm{SGL}}$1/2)方法。方法通过引入平滑组L1/2正则化实现组内稀疏,并将原先组L1/2方法中含有的非平滑的绝对值函数向平滑函数逼近,解决了组L1/2方法中数值计算振荡和收敛难的缺点。${\rm{SGL}}$1/2方法能够在保持分类精度的前提下,加速对模型的求解。同时在分类方法中,引入一个校准hinge函数(calibrated hinge,${\rm{Chinge}}$)代替标准支持向量机(support vector machine,SVM)中的hinge函数,形成校准SVM(calibrated SVM,C-SVM)用于疾病的分类,使处于分类平面附近的样本更倾向于分类的正确一侧,对一些难以区分的样本能够进行更好的分类。结果与其他组级别上的正则化方法相比,${\rm{SGL}}$1/2与校准支持向量机结合的分类模型对AD的识别具有更高的分类性能,分类准确率高达94.70%。结论本文提出的组稀疏分类模型,实现了组间稀疏和组内稀疏的优点,为未来AD的自动诊断提供了客观参照。关键词:阿尔茨海默症(AD);组L1/2稀疏正则化;校准支持向量机(C-SVM);结构化磁共振;组间稀疏;组内稀疏60|132|0更新时间:2024-05-07

磁共振图像

-

摘要:目的为了提升基于单模态B型超声($\rm B$超)的乳腺癌计算机辅助诊断(computer-aided diagnosis,CAD)模型性能,提出一种基于两阶段深度迁移学习(two-stage deep transfer learning,TSDTL)的乳腺超声CAD算法,将超声弹性图像中的有效信息迁移至基于$\rm B$超的乳腺癌CAD模型之中,进一步提升该CAD模型的性能。方法在第1阶段的深度迁移学习中,提出将双模态超声图像重建任务作为一种自监督学习任务,训练一个关联多模态深度卷积神经网络模型,实现$\rm B$超图像和超声弹性图像之间的信息交互迁移;在第2阶段的深度迁移学习中,基于隐式的特权信息学习(learning using privilaged information, LUPI)范式,进行基于双模态超声图像的乳腺肿瘤分类任务,通过标签信息引导下的分类进一步加强两个模态之间的特征融合与信息交互;采用单模态$\rm B$超数据对所对应通道的分类网络进行微调,实现最终的乳腺癌$\rm B$超图像分类模型。结果实验在一个乳腺肿瘤双模超声数据集上进行算法性能验证。实验结果表明,通过迁移超声弹性图像的信息,TSDTL在基于$\rm B$超的乳腺癌诊断任务中取得的平均分类准确率为87.84±2.08%、平均敏感度为88.89±3.70%、平均特异度为86.71±2.21%、平均约登指数为75.60±4.07%,优于直接基于单模态$\rm B$超训练的分类模型以及多种典型迁移学习算法。结论提出的TSDTL算法通过两阶段的深度迁移学习,将超声弹性图像的信息有效迁移至基于$\rm B$超的乳腺癌CAD模型,提升了模型的诊断性能,具备潜在的应用可行性。关键词:B型超声成像;超声弹性成像;乳腺癌计算机辅助诊断;特权信息学习(LUPI);深度迁移学习;自监督学习(SSL)47|72|3更新时间:2024-05-07

摘要:目的为了提升基于单模态B型超声($\rm B$超)的乳腺癌计算机辅助诊断(computer-aided diagnosis,CAD)模型性能,提出一种基于两阶段深度迁移学习(two-stage deep transfer learning,TSDTL)的乳腺超声CAD算法,将超声弹性图像中的有效信息迁移至基于$\rm B$超的乳腺癌CAD模型之中,进一步提升该CAD模型的性能。方法在第1阶段的深度迁移学习中,提出将双模态超声图像重建任务作为一种自监督学习任务,训练一个关联多模态深度卷积神经网络模型,实现$\rm B$超图像和超声弹性图像之间的信息交互迁移;在第2阶段的深度迁移学习中,基于隐式的特权信息学习(learning using privilaged information, LUPI)范式,进行基于双模态超声图像的乳腺肿瘤分类任务,通过标签信息引导下的分类进一步加强两个模态之间的特征融合与信息交互;采用单模态$\rm B$超数据对所对应通道的分类网络进行微调,实现最终的乳腺癌$\rm B$超图像分类模型。结果实验在一个乳腺肿瘤双模超声数据集上进行算法性能验证。实验结果表明,通过迁移超声弹性图像的信息,TSDTL在基于$\rm B$超的乳腺癌诊断任务中取得的平均分类准确率为87.84±2.08%、平均敏感度为88.89±3.70%、平均特异度为86.71±2.21%、平均约登指数为75.60±4.07%,优于直接基于单模态$\rm B$超训练的分类模型以及多种典型迁移学习算法。结论提出的TSDTL算法通过两阶段的深度迁移学习,将超声弹性图像的信息有效迁移至基于$\rm B$超的乳腺癌CAD模型,提升了模型的诊断性能,具备潜在的应用可行性。关键词:B型超声成像;超声弹性成像;乳腺癌计算机辅助诊断;特权信息学习(LUPI);深度迁移学习;自监督学习(SSL)47|72|3更新时间:2024-05-07 -

摘要:目的影像学医师通常通过观察乳腺B型超声(brightness-mode ultrasound)肿瘤区域进行良恶性分析,针对难以辨别的病例则融合其对应的超声造影(contrast-enhanced ultrasound, CEUS)特征进一步判别。由于超声图像灰度值范围变化小、良恶性表现重叠,特征提取模型如果不能关注到病灶区域将导致分类错误。为增强网络模型对重点区域的分析,本文提出一种基于病灶区域引导的注意力机制,同时融合双模态数据,实现乳腺超声良恶性的精准判别。方法通过对比实验,选取一个适合超声图像特征提取的主干分类模型ResNet34;为学习到更有分类意义的特征,以分割结节的掩膜图(region of interest,ROI-mask)作为引导注意力来修正浅层空间特征;将具有分类意义的超声造影各项评价特征向量化,与网络提取的深层特征进行融合分类。结果首先构建一个从医院收集的真实病例的乳腺超声数据集BM-Breast(breast ultrasound images dataset),与常见分类框架ResNet、Inception等进行对比实验,并与相关最新乳腺分类研究成果对比,结果显示本文设计的算法在各项指标上都有较大优势。本文提出的融合算法的分类准确性为87.45%,AUC(area under curve)为0.905。为了评估对注意力引导机制算法设计的结果,在本文实验数据集和公开数据集上分别进行实验,精度相比对比算法提升了3%,表明本文算法具有较好的泛化能力。实验结果表明,融合两种模态超声数据的特征可以提升最终分类精度。结论本文提出的注意力引导模型能够针对乳腺超声成像特点学习到可鉴别的分类特征,双模态数据特征融合诊断方法进一步提升了模型的分类能力。高特异性指标表现出模型对噪声样本的鲁棒性,能够较为准确地辨别出难以判别的病例,本文算法具有较高的临床指导价值。关键词:注意力机制;特征融合与分类;乳腺超声;双模态数据;智能诊断98|100|1更新时间:2024-05-07

摘要:目的影像学医师通常通过观察乳腺B型超声(brightness-mode ultrasound)肿瘤区域进行良恶性分析,针对难以辨别的病例则融合其对应的超声造影(contrast-enhanced ultrasound, CEUS)特征进一步判别。由于超声图像灰度值范围变化小、良恶性表现重叠,特征提取模型如果不能关注到病灶区域将导致分类错误。为增强网络模型对重点区域的分析,本文提出一种基于病灶区域引导的注意力机制,同时融合双模态数据,实现乳腺超声良恶性的精准判别。方法通过对比实验,选取一个适合超声图像特征提取的主干分类模型ResNet34;为学习到更有分类意义的特征,以分割结节的掩膜图(region of interest,ROI-mask)作为引导注意力来修正浅层空间特征;将具有分类意义的超声造影各项评价特征向量化,与网络提取的深层特征进行融合分类。结果首先构建一个从医院收集的真实病例的乳腺超声数据集BM-Breast(breast ultrasound images dataset),与常见分类框架ResNet、Inception等进行对比实验,并与相关最新乳腺分类研究成果对比,结果显示本文设计的算法在各项指标上都有较大优势。本文提出的融合算法的分类准确性为87.45%,AUC(area under curve)为0.905。为了评估对注意力引导机制算法设计的结果,在本文实验数据集和公开数据集上分别进行实验,精度相比对比算法提升了3%,表明本文算法具有较好的泛化能力。实验结果表明,融合两种模态超声数据的特征可以提升最终分类精度。结论本文提出的注意力引导模型能够针对乳腺超声成像特点学习到可鉴别的分类特征,双模态数据特征融合诊断方法进一步提升了模型的分类能力。高特异性指标表现出模型对噪声样本的鲁棒性,能够较为准确地辨别出难以判别的病例,本文算法具有较高的临床指导价值。关键词:注意力机制;特征融合与分类;乳腺超声;双模态数据;智能诊断98|100|1更新时间:2024-05-07

超声图像

-

摘要:目的急性缺血性卒中是最常见的脑卒中类型,具有发病率高、死亡率高和致残率高的特点。患者发病前症状不明显、发病急骤以及溶栓治疗时间窗窄等问题导致其成为临床上的高危疾病。中医望诊可以在疾病发展早期,通过观察患者形、色、气和神的变化,对患者病情进行诊断和预测,达到“治未病”的目的,与人工智能技术相结合,可以解决缺乏客观和定量评价标准的问题。因此,通过中医望诊中的脸部和手部图像,充分利用两种图像的颜色、纹理等特征以及二者之间的关系特征,本文提出一种基于序列自注意力网络的急性缺血性卒中辅助诊断方法。方法对脸部和手部图像进行山根和大鱼际处的感兴趣区域提取。采用$\rm YCbCr$颜色空间和灰度共生矩阵,提取区域图像的颜色和纹理特征,将颜色特征和纹理特征进行融合并将其与原图像特征相结合,得到的特征图序列化地输入到Transformer模型中,进一步学习高层次的空间特征和注意力特征。将模型输出结果输入到多层感知机中,从而实现急性缺血性卒中的检测。结果在收集的急性缺血性卒中患者数据集上进行实验,结果表明,提出的基于序列自注意力网络的方法取得了83.57%的准确率,获得较高性能,在速度和便携性上具有很大的优势。结论该方法采用端到端的学习方式,能够有效解决目前临床诊断因医疗资源的差异而受到影响的问题,对于初步判断患者疾病具有指导性的作用,为诊断急性缺血性卒中提供了一种新思路和新方法。关键词:中医望诊;特征提取;特征融合;端到端;Transformer176|193|3更新时间:2024-05-07

摘要:目的急性缺血性卒中是最常见的脑卒中类型,具有发病率高、死亡率高和致残率高的特点。患者发病前症状不明显、发病急骤以及溶栓治疗时间窗窄等问题导致其成为临床上的高危疾病。中医望诊可以在疾病发展早期,通过观察患者形、色、气和神的变化,对患者病情进行诊断和预测,达到“治未病”的目的,与人工智能技术相结合,可以解决缺乏客观和定量评价标准的问题。因此,通过中医望诊中的脸部和手部图像,充分利用两种图像的颜色、纹理等特征以及二者之间的关系特征,本文提出一种基于序列自注意力网络的急性缺血性卒中辅助诊断方法。方法对脸部和手部图像进行山根和大鱼际处的感兴趣区域提取。采用$\rm YCbCr$颜色空间和灰度共生矩阵,提取区域图像的颜色和纹理特征,将颜色特征和纹理特征进行融合并将其与原图像特征相结合,得到的特征图序列化地输入到Transformer模型中,进一步学习高层次的空间特征和注意力特征。将模型输出结果输入到多层感知机中,从而实现急性缺血性卒中的检测。结果在收集的急性缺血性卒中患者数据集上进行实验,结果表明,提出的基于序列自注意力网络的方法取得了83.57%的准确率,获得较高性能,在速度和便携性上具有很大的优势。结论该方法采用端到端的学习方式,能够有效解决目前临床诊断因医疗资源的差异而受到影响的问题,对于初步判断患者疾病具有指导性的作用,为诊断急性缺血性卒中提供了一种新思路和新方法。关键词:中医望诊;特征提取;特征融合;端到端;Transformer176|193|3更新时间:2024-05-07 -

摘要:目的脑卒中发病征兆不明显,发病速度快且致死率高,目前医学领域的主要诊疗手段仍是针对脑卒中病时和病后,但在病前预测方面缺少有效办法。中医对于治未病等效果显著,其中望诊更是中医诊疗的重要方式。本文结合中医望诊,基于面部与手部图像提出了一种多分支深度特征融合的中医脑卒中辅助诊断方法。方法针对不同部位图像,分别构建两部位的双分支特征提取模块,将面部和手部的重点区域作为主体分支提取主要特征。根据中医望诊在面部与手部诊疗的特点,进一步将眉心的纹理特征和掌心的颜色特征作为辅助信息提取辅助特征;在此基础上提出信息交互模块(information interaction module,IIM),将主要特征与辅助特征进行有效信息交互,从而辅助主体分支提取更有区别性的信息;最终将两部位的特征进行融合降维用于脑卒中辅助诊断。结果本文将采集的3 011例面部和手部图像数据进行筛查扩充后作为实验数据集,并在不同评价指标下与当前主流的分类模型进行对比。实验结果表明,本文方法在准确性上达到了83.36%,相比ResNet-34、DenseNet121、VGG16(Visual Geometry Group 16-layer net)和InceptionV3等其他主流分类模型性能提高了3%~7%;在特异性和敏感性方面分别为82.47% 和85.10%,其效果优于对比方法。结论本文方法能够有效结合中医望诊的诊疗经验并通过传统面部和手部图像实现对脑卒中的有效预测,为中医望诊在脑卒中方面的客观化和便捷化发展提供了帮助。关键词:中医望诊;脑卒中;图像识别;特征提取;特征融合;卷积神经网络82|270|0更新时间:2024-05-07

摘要:目的脑卒中发病征兆不明显,发病速度快且致死率高,目前医学领域的主要诊疗手段仍是针对脑卒中病时和病后,但在病前预测方面缺少有效办法。中医对于治未病等效果显著,其中望诊更是中医诊疗的重要方式。本文结合中医望诊,基于面部与手部图像提出了一种多分支深度特征融合的中医脑卒中辅助诊断方法。方法针对不同部位图像,分别构建两部位的双分支特征提取模块,将面部和手部的重点区域作为主体分支提取主要特征。根据中医望诊在面部与手部诊疗的特点,进一步将眉心的纹理特征和掌心的颜色特征作为辅助信息提取辅助特征;在此基础上提出信息交互模块(information interaction module,IIM),将主要特征与辅助特征进行有效信息交互,从而辅助主体分支提取更有区别性的信息;最终将两部位的特征进行融合降维用于脑卒中辅助诊断。结果本文将采集的3 011例面部和手部图像数据进行筛查扩充后作为实验数据集,并在不同评价指标下与当前主流的分类模型进行对比。实验结果表明,本文方法在准确性上达到了83.36%,相比ResNet-34、DenseNet121、VGG16(Visual Geometry Group 16-layer net)和InceptionV3等其他主流分类模型性能提高了3%~7%;在特异性和敏感性方面分别为82.47% 和85.10%,其效果优于对比方法。结论本文方法能够有效结合中医望诊的诊疗经验并通过传统面部和手部图像实现对脑卒中的有效预测,为中医望诊在脑卒中方面的客观化和便捷化发展提供了帮助。关键词:中医望诊;脑卒中;图像识别;特征提取;特征融合;卷积神经网络82|270|0更新时间:2024-05-07

中医图像

-

摘要:目的核性白内障是主要致盲和导致视觉损害的眼科疾病,早期干预和白内障手术可以有效改善患者的视力和生活质量。眼前节光学相干断层成像图像(anterior segment optical coherence tomography,AS-OCT)能够非接触、客观和快速地获取白内障混浊信息。临床研究已经发现在AS-OCT图像中核性白内障严重程度与核性区域像素特征, 如均值存在强相关性和高可重复性。但目前基于AS-OCT图像的自动核性白内障分类工作较少且分类结果还有较大提升空间。为此,本文提出一种新颖的多区域融合注意力网络(multi-region fusion attention network,MRA-Net)对AS-OCT图像中的核性白内障严重程度进行精准分类。方法在提出的多区域融合注意力模型中,本文设计了一个多区域融合注意力模块(multi-region fusion attention,MRA),对不同核性区域特征表示进行融合来增强分类结果;另外,本文验证了以人和眼为单位的AS-OCT图像数据集拆分方式对核性白内障分类结果的影响。结果在一个自建的AS-OCT图像数据集上结果表明,本文模型的总体分类准确率为87.78%,比对比方法至少提高了1%。在10种分类算法上的结果表明:以眼为单位的AS-OCT数据集优于以人为单位的AS-OCT数据集的分类结果,F1和Kappa评价指标分别最大提升了4.03%和8%。结论本文模型考虑了特征图不同区域特征分布的差异性,使核性白内障分类更加准确;不同数据集拆分方式的结果表明,考虑到同一个人两只眼的核性白内障严重程度相似,建议白内障的AS-OCT图像数据集拆分以人为单位。关键词:核性白内障分类;眼前节光学相干断层成像图像(AS-OCT);多区域融合注意力模块;深度学习;核性区域103|232|2更新时间:2024-05-07

摘要:目的核性白内障是主要致盲和导致视觉损害的眼科疾病,早期干预和白内障手术可以有效改善患者的视力和生活质量。眼前节光学相干断层成像图像(anterior segment optical coherence tomography,AS-OCT)能够非接触、客观和快速地获取白内障混浊信息。临床研究已经发现在AS-OCT图像中核性白内障严重程度与核性区域像素特征, 如均值存在强相关性和高可重复性。但目前基于AS-OCT图像的自动核性白内障分类工作较少且分类结果还有较大提升空间。为此,本文提出一种新颖的多区域融合注意力网络(multi-region fusion attention network,MRA-Net)对AS-OCT图像中的核性白内障严重程度进行精准分类。方法在提出的多区域融合注意力模型中,本文设计了一个多区域融合注意力模块(multi-region fusion attention,MRA),对不同核性区域特征表示进行融合来增强分类结果;另外,本文验证了以人和眼为单位的AS-OCT图像数据集拆分方式对核性白内障分类结果的影响。结果在一个自建的AS-OCT图像数据集上结果表明,本文模型的总体分类准确率为87.78%,比对比方法至少提高了1%。在10种分类算法上的结果表明:以眼为单位的AS-OCT数据集优于以人为单位的AS-OCT数据集的分类结果,F1和Kappa评价指标分别最大提升了4.03%和8%。结论本文模型考虑了特征图不同区域特征分布的差异性,使核性白内障分类更加准确;不同数据集拆分方式的结果表明,考虑到同一个人两只眼的核性白内障严重程度相似,建议白内障的AS-OCT图像数据集拆分以人为单位。关键词:核性白内障分类;眼前节光学相干断层成像图像(AS-OCT);多区域融合注意力模块;深度学习;核性区域103|232|2更新时间:2024-05-07 -

摘要:目的条纹状损伤是高度近视向病理性近视发展过程中的一种重要眼底改变。临床研究表明,在无创的眼底光学相干断层扫描(optical coherence tomography,OCT)图像中,条纹状损伤主要表现为视网膜色素上皮层—Bruch's膜—脉络膜毛细血管复合体(retinal pigment epithelium-Bruch's membrane-choriocapillario complex,RBCC)损伤,具体包括RBCC异常和近视牵引纹。由于OCT图像中条纹损伤存在目标小、边界模糊等问题,其自动分割极具挑战性。本文提出了一种基于特征聚合下采样和密集语义流监督的特征融合分割网络(deep-supervision and feature-aggregation based network,DSFA-Net),用于实现OCT图像中条纹损伤的自动分割。方法为减少网络参数量,DSFA-Net以通道减半的U-Net为基准网络,在编码器路径中设计并嵌入特征聚合下采样模块(feature aggregation pooling module,FAPM),使得网络在下采样过程中保留更多的上下文和局部信息,在解码器路径中设计并嵌入一种新的深监督模块——密集语义流监督模块(dense semantic flow supervision module,DSFSM),使得网络在解码过程中聚合不同分辨率图像之间的细节和语义信息。结果方法在上海市第一人民医院提供的751幅2维眼底OCT B扫描图像上进行验证与评估。相比于U-Net,本文方法在参数量降低53.19%的情况下,平均Dice相似系数(Dice similarity coefficient,DSC)、Jaccard和敏感度指标分别提高了4.30%、4.60%和2.35%。与多种较流行的语义分割网络相比,本文网络在保持最小网络参数量的同时,分割性能取得了较明显提升。为了更加客观地评估FAPM与DSFSM模块的性能,本文同时进行了一系列消融实验。在基准网络添加FAPM模块后,平均DSC、Jaccard和敏感度指标分别提高了1.05%、1.35%和3.35%。在基准网络添加DSFSM模块后,平均DSC、Jaccard和敏感度指标分别提高了4.90%、5.35%和5.90%。在基准网络添加FAPM与DSFSM模块后,平均DSC、Jaccard和敏感度指标分别提高了6.00%、6.45%和5.50%。消融实验的结果表明,本文提出的DSFSM和FAPM模块可以有效提升网络的分割性能。结论本文提出的DSFA-Net提升了眼底OCT图像中条纹损伤的分割精度,具备潜在的临床应用价值。关键词:高度近视;条纹损伤;光学相干断层扫描(OCT);深监督;特征聚合;卷积神经网络(CNN);医学图像分割82|142|0更新时间:2024-05-07

摘要:目的条纹状损伤是高度近视向病理性近视发展过程中的一种重要眼底改变。临床研究表明,在无创的眼底光学相干断层扫描(optical coherence tomography,OCT)图像中,条纹状损伤主要表现为视网膜色素上皮层—Bruch's膜—脉络膜毛细血管复合体(retinal pigment epithelium-Bruch's membrane-choriocapillario complex,RBCC)损伤,具体包括RBCC异常和近视牵引纹。由于OCT图像中条纹损伤存在目标小、边界模糊等问题,其自动分割极具挑战性。本文提出了一种基于特征聚合下采样和密集语义流监督的特征融合分割网络(deep-supervision and feature-aggregation based network,DSFA-Net),用于实现OCT图像中条纹损伤的自动分割。方法为减少网络参数量,DSFA-Net以通道减半的U-Net为基准网络,在编码器路径中设计并嵌入特征聚合下采样模块(feature aggregation pooling module,FAPM),使得网络在下采样过程中保留更多的上下文和局部信息,在解码器路径中设计并嵌入一种新的深监督模块——密集语义流监督模块(dense semantic flow supervision module,DSFSM),使得网络在解码过程中聚合不同分辨率图像之间的细节和语义信息。结果方法在上海市第一人民医院提供的751幅2维眼底OCT B扫描图像上进行验证与评估。相比于U-Net,本文方法在参数量降低53.19%的情况下,平均Dice相似系数(Dice similarity coefficient,DSC)、Jaccard和敏感度指标分别提高了4.30%、4.60%和2.35%。与多种较流行的语义分割网络相比,本文网络在保持最小网络参数量的同时,分割性能取得了较明显提升。为了更加客观地评估FAPM与DSFSM模块的性能,本文同时进行了一系列消融实验。在基准网络添加FAPM模块后,平均DSC、Jaccard和敏感度指标分别提高了1.05%、1.35%和3.35%。在基准网络添加DSFSM模块后,平均DSC、Jaccard和敏感度指标分别提高了4.90%、5.35%和5.90%。在基准网络添加FAPM与DSFSM模块后,平均DSC、Jaccard和敏感度指标分别提高了6.00%、6.45%和5.50%。消融实验的结果表明,本文提出的DSFSM和FAPM模块可以有效提升网络的分割性能。结论本文提出的DSFA-Net提升了眼底OCT图像中条纹损伤的分割精度,具备潜在的临床应用价值。关键词:高度近视;条纹损伤;光学相干断层扫描(OCT);深监督;特征聚合;卷积神经网络(CNN);医学图像分割82|142|0更新时间:2024-05-07 -

摘要:目的在骨龄智能评估研究中,如何准确地提取手腕参照骨的兴趣区域(region of interest, ROI)是保证骨龄精确评估的关键。基于传统深度学习的方法用于手腕骨ROI提取,存在个别参照骨漏判、误判等情况,导致平均提取准确率较低。本文结合目标检测强大的定位和识别能力,以准确提取所有手腕骨ROI为目的,提出了一种参照骨自动匹配与修正方法。方法针对不同参照骨形状、位置等特征表现出的规律性和关联性,本文采集了大量不同性别、不同年龄段的人手腕图谱作为参照骨样本匹配,然后分多个阶段提取参照骨ROI:1)基于目标检测算法初步提取出所有参照骨候选ROI,并根据一定的阈值剔除置信度较低的区域;2)结合参照骨的大数据样本构建位置点匹配模型,对剔除区域进行自动匹配与填补,保证ROI提取的完整性;3)通过多尺度滑动窗口以及ROI分类模型,对填补得到的ROI位置进行滑动修正,进一步保证提取准确率。结果实验结果表明,本文结合目标检测与匹配修正的方法优于现有绝大多数方法。其中,匹配修正方法在目标检测算法的提取结果基础上,提升了约1.42%的平均准确率,当结合Faster R-CNN(region-convolutional neural network)算法时能达到最高98.45%的交并比(intersection-over-union, IoU)准确率。结论本文方法利用手腕骨的位置特征,对个别提取困难的参照骨类型进行重新匹配与修正,有效地弥补了传统方法泛化能力不足的缺点。本文方法能够同时面向人手腕中所有参照骨ROI提取,具备良好的扩展性和易操作性。关键词:兴趣区域(ROI);目标检测;位置匹配;大数据;滑动窗口64|207|0更新时间:2024-05-07

摘要:目的在骨龄智能评估研究中,如何准确地提取手腕参照骨的兴趣区域(region of interest, ROI)是保证骨龄精确评估的关键。基于传统深度学习的方法用于手腕骨ROI提取,存在个别参照骨漏判、误判等情况,导致平均提取准确率较低。本文结合目标检测强大的定位和识别能力,以准确提取所有手腕骨ROI为目的,提出了一种参照骨自动匹配与修正方法。方法针对不同参照骨形状、位置等特征表现出的规律性和关联性,本文采集了大量不同性别、不同年龄段的人手腕图谱作为参照骨样本匹配,然后分多个阶段提取参照骨ROI:1)基于目标检测算法初步提取出所有参照骨候选ROI,并根据一定的阈值剔除置信度较低的区域;2)结合参照骨的大数据样本构建位置点匹配模型,对剔除区域进行自动匹配与填补,保证ROI提取的完整性;3)通过多尺度滑动窗口以及ROI分类模型,对填补得到的ROI位置进行滑动修正,进一步保证提取准确率。结果实验结果表明,本文结合目标检测与匹配修正的方法优于现有绝大多数方法。其中,匹配修正方法在目标检测算法的提取结果基础上,提升了约1.42%的平均准确率,当结合Faster R-CNN(region-convolutional neural network)算法时能达到最高98.45%的交并比(intersection-over-union, IoU)准确率。结论本文方法利用手腕骨的位置特征,对个别提取困难的参照骨类型进行重新匹配与修正,有效地弥补了传统方法泛化能力不足的缺点。本文方法能够同时面向人手腕中所有参照骨ROI提取,具备良好的扩展性和易操作性。关键词:兴趣区域(ROI);目标检测;位置匹配;大数据;滑动窗口64|207|0更新时间:2024-05-07 -

摘要:目的旷场实验(open field test,OFT)是行为学与药理实验分析中常用的实验方法。为了对比测试组和参考组被测小鼠的行为特征差异,通常需要耗费大量精力对旷场实验数据进行处理和观测。由于旷场实验数据量大且较依赖观测人员的主观判断,导致对小鼠行为差异观测的精度较低且缺乏量化评价指标。为此,本文提出一种基于卷积神经网络(convolutional neural networks,CNN)的旷场实验视频分类方法,可基于量化特征对两组小鼠的行为差异自动分类。方法从视频空域和时域中提取22维的小鼠运动行为特征,经过量化后生成特征矩阵,进而以矩阵拼接方式构造可学习的行为特征矩阵样本,利用不同结构卷积神经网络对提取的行为特征矩阵样本进行训练和分类,并分析网络结构对分类结果的影响,在实现两组小鼠分类的基础上,对不同维度小鼠行为特征对分类精度的重要性进行评价。结果在真实旷场实验数据集上的实验分析表明,本文算法的分类准确率为99.25%。此外,由实验结果分析发现小鼠的大角度转向频次、停留区域与时间对小鼠分类的重要性高于其他维度特征。结论提出的特征拼接矩阵学习方法能够准确识别两组小鼠旷场实验视频的差异,本文方法的分类准确率明显优于现有人工分析及经典机器学习方法。关键词:旷场实验(OFT);行为分析;视频分类;特征拼接矩阵;卷积神经网络(CNN)52|110|1更新时间:2024-05-07

摘要:目的旷场实验(open field test,OFT)是行为学与药理实验分析中常用的实验方法。为了对比测试组和参考组被测小鼠的行为特征差异,通常需要耗费大量精力对旷场实验数据进行处理和观测。由于旷场实验数据量大且较依赖观测人员的主观判断,导致对小鼠行为差异观测的精度较低且缺乏量化评价指标。为此,本文提出一种基于卷积神经网络(convolutional neural networks,CNN)的旷场实验视频分类方法,可基于量化特征对两组小鼠的行为差异自动分类。方法从视频空域和时域中提取22维的小鼠运动行为特征,经过量化后生成特征矩阵,进而以矩阵拼接方式构造可学习的行为特征矩阵样本,利用不同结构卷积神经网络对提取的行为特征矩阵样本进行训练和分类,并分析网络结构对分类结果的影响,在实现两组小鼠分类的基础上,对不同维度小鼠行为特征对分类精度的重要性进行评价。结果在真实旷场实验数据集上的实验分析表明,本文算法的分类准确率为99.25%。此外,由实验结果分析发现小鼠的大角度转向频次、停留区域与时间对小鼠分类的重要性高于其他维度特征。结论提出的特征拼接矩阵学习方法能够准确识别两组小鼠旷场实验视频的差异,本文方法的分类准确率明显优于现有人工分析及经典机器学习方法。关键词:旷场实验(OFT);行为分析;视频分类;特征拼接矩阵;卷积神经网络(CNN)52|110|1更新时间:2024-05-07 -

摘要:目的血管介入手术中介入器械与血管壁之间的接触力对手术安全有着重要意义,然而目前缺乏直接测量器械前端与血管壁接触力的传感器和有效手段。为解决这一难题,本文提出了一种通过图像观察器械前端变形程度从而估计器械与血管壁接触力的方法。方法通过模拟血管介入手术过程来获取介入器械导丝的变形量和与之相对应的力,从而对介入器械前端接触力与变形量关系进行建模。将介入器械前的端接触力分为垂直于接触面方向的力和沿着接触面方向的力并分别加以处理;使用介入器械前端变形段的最大曲率变化量描述器械变形量,通过图像观察导丝变形来计算导丝的最大曲率。为求解最大曲率,使用器械上3个点构成的三角形并求其外接圆曲率来表示这3点所在段的曲率,在介入器械前端进行依次遍历求取最大值以获得最大曲率。通过实验分析验证介入器械受力与最大曲率之间的关系。结果实验表明介入器械前端的接触力与器械前端最大曲率变化率之间存在着映射关系,且这种关系能用函数表达式准确地表达出来,通过函数式来预测受力的平均误差在10%以内。结论研究表明,通过图像分析导丝前端的变形量、估计导丝前端接触力,进而判断血管手术过程中介入器械与血管壁的接触状态的方法是可行的,所计算的导丝前端受力能为手术过程提供参考信息。关键词:血管介入手术;介入器械接触力;介入器械变形量;导丝图像;最大曲率79|148|1更新时间:2024-05-07

摘要:目的血管介入手术中介入器械与血管壁之间的接触力对手术安全有着重要意义,然而目前缺乏直接测量器械前端与血管壁接触力的传感器和有效手段。为解决这一难题,本文提出了一种通过图像观察器械前端变形程度从而估计器械与血管壁接触力的方法。方法通过模拟血管介入手术过程来获取介入器械导丝的变形量和与之相对应的力,从而对介入器械前端接触力与变形量关系进行建模。将介入器械前的端接触力分为垂直于接触面方向的力和沿着接触面方向的力并分别加以处理;使用介入器械前端变形段的最大曲率变化量描述器械变形量,通过图像观察导丝变形来计算导丝的最大曲率。为求解最大曲率,使用器械上3个点构成的三角形并求其外接圆曲率来表示这3点所在段的曲率,在介入器械前端进行依次遍历求取最大值以获得最大曲率。通过实验分析验证介入器械受力与最大曲率之间的关系。结果实验表明介入器械前端的接触力与器械前端最大曲率变化率之间存在着映射关系,且这种关系能用函数表达式准确地表达出来,通过函数式来预测受力的平均误差在10%以内。结论研究表明,通过图像分析导丝前端的变形量、估计导丝前端接触力,进而判断血管手术过程中介入器械与血管壁的接触状态的方法是可行的,所计算的导丝前端受力能为手术过程提供参考信息。关键词:血管介入手术;介入器械接触力;介入器械变形量;导丝图像;最大曲率79|148|1更新时间:2024-05-07

研究应用

0