最新刊期

2019 年 第 24 卷 第 6 期

-

摘要:目的 拍摄过程中,如果摄像机进行了错误的聚焦,就会得到模糊的图像,如何将模糊图像变得清晰成为一个亟待解决的问题。目前关于图像的去模糊方法多采用基于模糊核约束的卷积模型。但是由于实际应用中很难准确获取模糊核的信息,同时计算机也存在精度限制,计算结果与实际物理模型有偏差,因而去模糊的主要挑战为:如何精确地估计模糊核,以及如何在复原过程中减弱由于精度限制造成的振铃效应。方法 振铃效应是指图像的灰度剧烈变化处产生的震荡,类似于钟被敲击后产生的波状空气震荡。在图像复原过程中,此效应通常发生在梯度变化较大的边缘区域附近。本文对此进行研究,在去模糊过程中引入边缘信息作为约束条件,以改善模糊核的估计,并通过抑制边缘区域的反卷积,抑制图像复原过程中的振铃效应。算法主要分为如下3个部分:1)设计了适用于模糊图像的边缘提取算法;2)利用边缘信息设计了加强边缘感知的反卷积算法;3)提出并设计了安全检测子,以保证算法在边缘区域复原的完整性。结果 实验结果表明,在没有先验知识的情况下,本文方法可以较好地恢复图像细节,并有效抑制振铃效应。较之传统的去模糊处理算法,本文方法在性能上有较大提高。比如,相比于Chan、Krishnan以及Hu的方法,本文方法在峰值信噪比指标上分别提高了25.73%、3.52%和4.43%,在结构相似性指标上分别提高了7.67%、1.63%和3.59%。同时,与基于深度学习的方法相比,本文方法不依赖于数据集,鲁棒性更强。结论 本文方法可以较好地恢复图像细节,并抑制振铃效应,同时比深度学习方法适用范围更广。关键词:图像去模糊;模糊核估计;振铃效应;边缘算子融合;加权去卷积72|256|2更新时间:2024-05-07

摘要:目的 拍摄过程中,如果摄像机进行了错误的聚焦,就会得到模糊的图像,如何将模糊图像变得清晰成为一个亟待解决的问题。目前关于图像的去模糊方法多采用基于模糊核约束的卷积模型。但是由于实际应用中很难准确获取模糊核的信息,同时计算机也存在精度限制,计算结果与实际物理模型有偏差,因而去模糊的主要挑战为:如何精确地估计模糊核,以及如何在复原过程中减弱由于精度限制造成的振铃效应。方法 振铃效应是指图像的灰度剧烈变化处产生的震荡,类似于钟被敲击后产生的波状空气震荡。在图像复原过程中,此效应通常发生在梯度变化较大的边缘区域附近。本文对此进行研究,在去模糊过程中引入边缘信息作为约束条件,以改善模糊核的估计,并通过抑制边缘区域的反卷积,抑制图像复原过程中的振铃效应。算法主要分为如下3个部分:1)设计了适用于模糊图像的边缘提取算法;2)利用边缘信息设计了加强边缘感知的反卷积算法;3)提出并设计了安全检测子,以保证算法在边缘区域复原的完整性。结果 实验结果表明,在没有先验知识的情况下,本文方法可以较好地恢复图像细节,并有效抑制振铃效应。较之传统的去模糊处理算法,本文方法在性能上有较大提高。比如,相比于Chan、Krishnan以及Hu的方法,本文方法在峰值信噪比指标上分别提高了25.73%、3.52%和4.43%,在结构相似性指标上分别提高了7.67%、1.63%和3.59%。同时,与基于深度学习的方法相比,本文方法不依赖于数据集,鲁棒性更强。结论 本文方法可以较好地恢复图像细节,并抑制振铃效应,同时比深度学习方法适用范围更广。关键词:图像去模糊;模糊核估计;振铃效应;边缘算子融合;加权去卷积72|256|2更新时间:2024-05-07

图像处理和编码

-

摘要:目的 钢板表面缺陷的种类多样、灰度结构复杂,现有的图像分割技术运用在灰度结构复杂、目标边缘模糊的钢板缺陷图像中仍然存在识别效率低、过分割现象明显等问题,本文结合图像灰度矩阵的空间特征,提出一种基于3维灰度矩阵的钢板表面缺陷识别算法。方法 首先根据灰度图像构建3维灰度矩阵;然后引入半类间方差改进克里金插值算法,绘制3维灰度矩阵的等值线图;接着构建等值线的拓扑关系树;最后根据自定义的全局搜索策略和局部搜索策略相结合,寻找局部凹凸区域,从而定位缺陷区域,达到分割钢板表面缺陷的目的。结果 本文方法能有效地识别钢板表面缺陷区域,对光照变化不敏感,在保证低误差率的前提下,提高了有效分割率。通过对氧化、辊印、结疤和气泡四类钢板缺陷图像进行测试,从分割效果和评价指标两方面对比其他钢板缺陷分割算法。与Fisher阈值分割法、经典的活动轮廓模型CV模型、基于半局部区域描述符的活动轮廓模型HTB模型和改进背景差分法进行分割效果对比,本文方法对四类钢板表面缺陷的识别更精确,分割结果更细致,一定程度上抑制了过分割现象。与大津法Ostu、1维最大模糊熵法1DMFE、最大模糊超熵法MFEE进行评价指标对比,得出对于分割孔洞和辊印图像,本文方法在误分割率均保持在2.0%以下的前提下,将有效信息率分别提升了1.6%和2.1%;对于夹杂图像,本文方法在3.4%的误分割率的前提下,具有85%以上的有效信息率。结论 提出的基于3维灰度矩阵的钢板缺陷图像识别算法可以有效地识别多种类型的钢板缺陷,即使在缺陷结构复杂的图像识别中仍具有较高的识别率。关键词:钢板表面缺陷识别;3维灰度矩阵;克里金插值算法;灰度等值线;拓扑关系树16|9|3更新时间:2024-05-07

摘要:目的 钢板表面缺陷的种类多样、灰度结构复杂,现有的图像分割技术运用在灰度结构复杂、目标边缘模糊的钢板缺陷图像中仍然存在识别效率低、过分割现象明显等问题,本文结合图像灰度矩阵的空间特征,提出一种基于3维灰度矩阵的钢板表面缺陷识别算法。方法 首先根据灰度图像构建3维灰度矩阵;然后引入半类间方差改进克里金插值算法,绘制3维灰度矩阵的等值线图;接着构建等值线的拓扑关系树;最后根据自定义的全局搜索策略和局部搜索策略相结合,寻找局部凹凸区域,从而定位缺陷区域,达到分割钢板表面缺陷的目的。结果 本文方法能有效地识别钢板表面缺陷区域,对光照变化不敏感,在保证低误差率的前提下,提高了有效分割率。通过对氧化、辊印、结疤和气泡四类钢板缺陷图像进行测试,从分割效果和评价指标两方面对比其他钢板缺陷分割算法。与Fisher阈值分割法、经典的活动轮廓模型CV模型、基于半局部区域描述符的活动轮廓模型HTB模型和改进背景差分法进行分割效果对比,本文方法对四类钢板表面缺陷的识别更精确,分割结果更细致,一定程度上抑制了过分割现象。与大津法Ostu、1维最大模糊熵法1DMFE、最大模糊超熵法MFEE进行评价指标对比,得出对于分割孔洞和辊印图像,本文方法在误分割率均保持在2.0%以下的前提下,将有效信息率分别提升了1.6%和2.1%;对于夹杂图像,本文方法在3.4%的误分割率的前提下,具有85%以上的有效信息率。结论 提出的基于3维灰度矩阵的钢板缺陷图像识别算法可以有效地识别多种类型的钢板缺陷,即使在缺陷结构复杂的图像识别中仍具有较高的识别率。关键词:钢板表面缺陷识别;3维灰度矩阵;克里金插值算法;灰度等值线;拓扑关系树16|9|3更新时间:2024-05-07 -

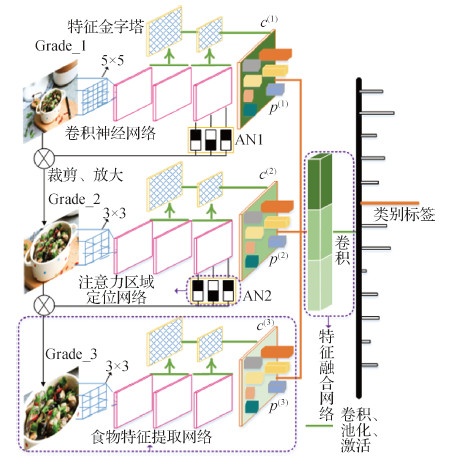

摘要:目的 食物图片具有结构多变、背景干扰大、类间差异小、类内差异大等特点,比普通细粒度图片的识别难度更大。目前在食物图片识别领域,食物图片的识别与分类仍存在精度低、泛化性差等问题。为了提高食物图片的识别与分类精度,充分利用食物图片的全局与局部细节信息,本文提出了一个多级卷积特征金字塔的细粒度食物图片识别模型。方法 本文模型从整体到局部逐级提取特征,将干扰较大的背景信息丢弃,仅针对食物目标区域提取特征。模型主要由食物特征提取网络、注意力区域定位网络和特征融合网格3部分组成,并采用3级食物特征提取网络的级联结构来实现特征由全局到局部的转移。此外,针对食物图片尺度变化大的特点,本文模型在每级食物特征提取网络中加入了特征金字塔结构,提高了模型对目标大小的鲁棒性。结果 本文模型在目前主流公开的食物图片数据集Food-101、ChineseFoodNet和Food-172上进行实验,分别获得了91.4%、82.8%、90.3%的Top-1正确率,与现有方法相比提高了1%~8%。结论 本文提出了一种多级卷积神经网络食物图片识别模型,可以自动定位食物图片区分度较大的区域,融合食物图片的全局与局部特征,实现了食物图片的细粒度识别,有效提高了食物图片的识别精度。实验结果表明,该模型在目前主流食物图片数据集上取得了最好的结果。关键词:食物图片识别;卷积神经网络;注意力网络;细粒度识别;特征金字塔46|37|3更新时间:2024-05-07

摘要:目的 食物图片具有结构多变、背景干扰大、类间差异小、类内差异大等特点,比普通细粒度图片的识别难度更大。目前在食物图片识别领域,食物图片的识别与分类仍存在精度低、泛化性差等问题。为了提高食物图片的识别与分类精度,充分利用食物图片的全局与局部细节信息,本文提出了一个多级卷积特征金字塔的细粒度食物图片识别模型。方法 本文模型从整体到局部逐级提取特征,将干扰较大的背景信息丢弃,仅针对食物目标区域提取特征。模型主要由食物特征提取网络、注意力区域定位网络和特征融合网格3部分组成,并采用3级食物特征提取网络的级联结构来实现特征由全局到局部的转移。此外,针对食物图片尺度变化大的特点,本文模型在每级食物特征提取网络中加入了特征金字塔结构,提高了模型对目标大小的鲁棒性。结果 本文模型在目前主流公开的食物图片数据集Food-101、ChineseFoodNet和Food-172上进行实验,分别获得了91.4%、82.8%、90.3%的Top-1正确率,与现有方法相比提高了1%~8%。结论 本文提出了一种多级卷积神经网络食物图片识别模型,可以自动定位食物图片区分度较大的区域,融合食物图片的全局与局部特征,实现了食物图片的细粒度识别,有效提高了食物图片的识别精度。实验结果表明,该模型在目前主流食物图片数据集上取得了最好的结果。关键词:食物图片识别;卷积神经网络;注意力网络;细粒度识别;特征金字塔46|37|3更新时间:2024-05-07 -

摘要:目的 针对传统Grab Cut算法需要人工交互操作,无法实现合成孔径雷达(SAR)图像的自动分割,且方式单一(仅利用边界或纹理信息中的一种)的问题,提出一种综合利用边界和纹理信息的改进Grab Cut算法,实现对SAR图像目标的自动分割。方法 首先将其他格式的彩色或灰度SAR图像转化为24 bit的位图,采用图形理论对整幅SAR图像建模,根据最大流算法找到描述图的能量函数最小的割集,从而分割出目标区域;然后采用中值滤波抑制相干噪声;最后通过邻域生长算法滤除图像斑点和小目标的干扰,从而达到目标边界的连接,实现自动对SAR图像中的目标进行分割。结果 在64位Window 7环境下采用MATLAB R2014处理平台,对楼房、车库、大树、汽车群等4幅分辨率不同的SAR图像进行目标分割实验,特征目标被自动分割出来,耗时分别为1.69 s、1.58 s、1.84 s和3.09 s,相比Mean-shift和Otsu算法,平均计算效率分别提升150%和3%,并且图像中的背景杂波、目标阴影和干扰小目标均被有效去除。结论 综合利用边界和纹理信息能够有效抑制相干噪声,去除图像斑点和小目标的干扰,从而达到目标边界的连接,实现对SAR图像目标的自动分割。实验结果表明,本文算法可以满足工程化应用要求,自适应性强,分割精度高,且具有较好的鲁棒性。关键词:合成孔径雷达图像;目标分割;Maxflow算法;中值滤波;邻域生长算法28|149|4更新时间:2024-05-07

摘要:目的 针对传统Grab Cut算法需要人工交互操作,无法实现合成孔径雷达(SAR)图像的自动分割,且方式单一(仅利用边界或纹理信息中的一种)的问题,提出一种综合利用边界和纹理信息的改进Grab Cut算法,实现对SAR图像目标的自动分割。方法 首先将其他格式的彩色或灰度SAR图像转化为24 bit的位图,采用图形理论对整幅SAR图像建模,根据最大流算法找到描述图的能量函数最小的割集,从而分割出目标区域;然后采用中值滤波抑制相干噪声;最后通过邻域生长算法滤除图像斑点和小目标的干扰,从而达到目标边界的连接,实现自动对SAR图像中的目标进行分割。结果 在64位Window 7环境下采用MATLAB R2014处理平台,对楼房、车库、大树、汽车群等4幅分辨率不同的SAR图像进行目标分割实验,特征目标被自动分割出来,耗时分别为1.69 s、1.58 s、1.84 s和3.09 s,相比Mean-shift和Otsu算法,平均计算效率分别提升150%和3%,并且图像中的背景杂波、目标阴影和干扰小目标均被有效去除。结论 综合利用边界和纹理信息能够有效抑制相干噪声,去除图像斑点和小目标的干扰,从而达到目标边界的连接,实现对SAR图像目标的自动分割。实验结果表明,本文算法可以满足工程化应用要求,自适应性强,分割精度高,且具有较好的鲁棒性。关键词:合成孔径雷达图像;目标分割;Maxflow算法;中值滤波;邻域生长算法28|149|4更新时间:2024-05-07 -

摘要:目的在序列图像或多视角图像的目标分割中,传统的协同分割算法对复杂的多图像分割鲁棒性不强,而现有的深度学习算法在前景和背景存在较大歧义时容易导致目标分割错误和分割不一致。为此,提出一种基于深度特征的融合分割先验的多图像分割算法。方法首先,为了使模型更好地学习复杂场景下多视角图像的细节特征,通过融合浅层网络高分辨率的细节特征来改进PSPNet-50网络模型,减小随着网络的加深导致空间信息的丢失对分割边缘细节的影响。然后通过交互分割算法获取一至两幅图像的分割先验,将少量分割先验融合到新的模型中,通过网络的再学习来解决前景/背景的分割歧义以及多图像的分割一致性。最后通过构建全连接条件随机场模型,将深度卷积神经网络的识别能力和全连接条件随机场优化的定位精度耦合在一起,更好地处理边界定位问题。结果本文采用公共数据集的多图像集进行了分割测试。实验结果表明本文算法不但可以更好地分割出经过大量数据预训练过的目标类,而且对于没有预训练过的目标类,也能有效避免歧义的区域分割。本文算法不论是对前景与背景区别明显的较简单图像集,还是对前景与背景颜色相似的较复杂图像集,平均像素准确度(PA)和交并比(IOU)均大于95%。结论本文算法对各种场景的多图像分割都具有较强的鲁棒性,同时通过融入少量先验,使模型更有效地区分目标与背景,获得了分割目标的一致性。关键词:多图像;目标分割;深度学习;卷积神经网络;分割先验;条件随机场51|437|6更新时间:2024-05-07

摘要:目的在序列图像或多视角图像的目标分割中,传统的协同分割算法对复杂的多图像分割鲁棒性不强,而现有的深度学习算法在前景和背景存在较大歧义时容易导致目标分割错误和分割不一致。为此,提出一种基于深度特征的融合分割先验的多图像分割算法。方法首先,为了使模型更好地学习复杂场景下多视角图像的细节特征,通过融合浅层网络高分辨率的细节特征来改进PSPNet-50网络模型,减小随着网络的加深导致空间信息的丢失对分割边缘细节的影响。然后通过交互分割算法获取一至两幅图像的分割先验,将少量分割先验融合到新的模型中,通过网络的再学习来解决前景/背景的分割歧义以及多图像的分割一致性。最后通过构建全连接条件随机场模型,将深度卷积神经网络的识别能力和全连接条件随机场优化的定位精度耦合在一起,更好地处理边界定位问题。结果本文采用公共数据集的多图像集进行了分割测试。实验结果表明本文算法不但可以更好地分割出经过大量数据预训练过的目标类,而且对于没有预训练过的目标类,也能有效避免歧义的区域分割。本文算法不论是对前景与背景区别明显的较简单图像集,还是对前景与背景颜色相似的较复杂图像集,平均像素准确度(PA)和交并比(IOU)均大于95%。结论本文算法对各种场景的多图像分割都具有较强的鲁棒性,同时通过融入少量先验,使模型更有效地区分目标与背景,获得了分割目标的一致性。关键词:多图像;目标分割;深度学习;卷积神经网络;分割先验;条件随机场51|437|6更新时间:2024-05-07 -

摘要:目的针对手动设计的手指静脉质量特征计算过程复杂、鲁棒性差、表达效果不理想等问题,提出了基于级联优化CNN(卷积神经网络)进行多特征融合的手指静脉质量评估方法。方法以半自动化方式对手指静脉公开数据库MMCBNU_6000进行质量标注并用R-SMOTE(radom-synthetic minority over-sampling technique)算法平衡类别;将深度学习中的CNN结构应用到手指静脉质量评估并研究了不同的网络深度对表征手指静脉质量的影响;受到传统方法中将二值图像和灰度图像结合进行质量评估的启发,设计了两种融合灰度图像和二值图像的质量特征的模型:多通道CNN(MC-CNN)和级联优化CNN(CF-CNN),MC-CNN在训练和测试时均需要同时输入二值图像和灰度图像,CF-CNN在训练时分阶段输入二值图像和灰度图像,测试时只需输入灰度图像。结果本文设计的3种简单CNN结构(CNN-K,K=3,4,5)在MMCBNU_6000数据库上对测试集图像的分类正确率分别为93.31%、93.94%、85.63%,以灰度图像和二值图像分别作为CNN-4的输入在MMCBNU_6000数据库上对测试集图像的分类正确率对应为93.94%、91.92%,MC-CNN和CF-CNN在MMCBNU_6000数据库上对测试集图像的分类正确率分别为91.44%、94.62%,此外,与现有的其他算法相比,CF-CNN在MMCBNU_6000数据库上对高质量测试图像、低质量测试图像、整体测试集图像的分类正确率均最高。结论实验结果表明,基于CF-CNN学习到的融合质量特征比现有的手工特征和基于单一静脉形式学习到的特征表达效果更好,可以有效地对手指静脉图像进行高、低质量的区分。关键词:手指静脉质量评估;卷积神经网络;特征融合;多通道CNN;级联优化CNN17|7|3更新时间:2024-05-07

摘要:目的针对手动设计的手指静脉质量特征计算过程复杂、鲁棒性差、表达效果不理想等问题,提出了基于级联优化CNN(卷积神经网络)进行多特征融合的手指静脉质量评估方法。方法以半自动化方式对手指静脉公开数据库MMCBNU_6000进行质量标注并用R-SMOTE(radom-synthetic minority over-sampling technique)算法平衡类别;将深度学习中的CNN结构应用到手指静脉质量评估并研究了不同的网络深度对表征手指静脉质量的影响;受到传统方法中将二值图像和灰度图像结合进行质量评估的启发,设计了两种融合灰度图像和二值图像的质量特征的模型:多通道CNN(MC-CNN)和级联优化CNN(CF-CNN),MC-CNN在训练和测试时均需要同时输入二值图像和灰度图像,CF-CNN在训练时分阶段输入二值图像和灰度图像,测试时只需输入灰度图像。结果本文设计的3种简单CNN结构(CNN-K,K=3,4,5)在MMCBNU_6000数据库上对测试集图像的分类正确率分别为93.31%、93.94%、85.63%,以灰度图像和二值图像分别作为CNN-4的输入在MMCBNU_6000数据库上对测试集图像的分类正确率对应为93.94%、91.92%,MC-CNN和CF-CNN在MMCBNU_6000数据库上对测试集图像的分类正确率分别为91.44%、94.62%,此外,与现有的其他算法相比,CF-CNN在MMCBNU_6000数据库上对高质量测试图像、低质量测试图像、整体测试集图像的分类正确率均最高。结论实验结果表明,基于CF-CNN学习到的融合质量特征比现有的手工特征和基于单一静脉形式学习到的特征表达效果更好,可以有效地对手指静脉图像进行高、低质量的区分。关键词:手指静脉质量评估;卷积神经网络;特征融合;多通道CNN;级联优化CNN17|7|3更新时间:2024-05-07 -

摘要:目的视线追踪是人机交互的辅助系统,针对传统的虹膜定位方法误判率高且耗时较长的问题,本文提出了一种基于人眼几何特征的视线追踪方法,以提高在2维环境下视线追踪的准确率。方法首先通过人脸定位算法定位人脸位置,使用人脸特征点检测的特征点定位眼角点位置,通过眼角点计算出人眼的位置。直接使用虹膜中心定位算法的耗时较长,为了使虹膜中心定位的速度加快,先利用虹膜图片建立虹膜模板,然后利用虹膜模板检测出虹膜区域的位置,通过虹膜中心精定位算法定位虹膜中心的位置,最后提取出眼角点、虹膜中心点等信息,对点中包含的角度信息、距离信息进行提取,组合成眼动向量特征。使用神经网络模型进行分类,建立注视点映射关系,实现视线的追踪。通过图像的预处理对图像进行增强,之后提取到了相对的虹膜中心。提取到需要的特征点,建立相对稳定的几何特征代表眼动特征。结果在普通的实验光照环境中,头部姿态固定的情况下,识别率最高达到98.9%,平均识别率达到95.74%。而当头部姿态在限制区域内发生变化时,仍能保持较高的识别率,平均识别率达到了90%以上。通过实验分析发现,在头部变化的限制区域内,本文方法具有良好的鲁棒性。结论本文提出使用模板匹配与虹膜精定位相结合的方法来快速定位虹膜中心,利用神经网络来对视线落点进行映射,计算视线落点区域,实验证明本文方法具有较高的精度。关键词:几何特征;虹膜模板;虹膜中心;眼动向量特征;注视点22|108|0更新时间:2024-05-07

摘要:目的视线追踪是人机交互的辅助系统,针对传统的虹膜定位方法误判率高且耗时较长的问题,本文提出了一种基于人眼几何特征的视线追踪方法,以提高在2维环境下视线追踪的准确率。方法首先通过人脸定位算法定位人脸位置,使用人脸特征点检测的特征点定位眼角点位置,通过眼角点计算出人眼的位置。直接使用虹膜中心定位算法的耗时较长,为了使虹膜中心定位的速度加快,先利用虹膜图片建立虹膜模板,然后利用虹膜模板检测出虹膜区域的位置,通过虹膜中心精定位算法定位虹膜中心的位置,最后提取出眼角点、虹膜中心点等信息,对点中包含的角度信息、距离信息进行提取,组合成眼动向量特征。使用神经网络模型进行分类,建立注视点映射关系,实现视线的追踪。通过图像的预处理对图像进行增强,之后提取到了相对的虹膜中心。提取到需要的特征点,建立相对稳定的几何特征代表眼动特征。结果在普通的实验光照环境中,头部姿态固定的情况下,识别率最高达到98.9%,平均识别率达到95.74%。而当头部姿态在限制区域内发生变化时,仍能保持较高的识别率,平均识别率达到了90%以上。通过实验分析发现,在头部变化的限制区域内,本文方法具有良好的鲁棒性。结论本文提出使用模板匹配与虹膜精定位相结合的方法来快速定位虹膜中心,利用神经网络来对视线落点进行映射,计算视线落点区域,实验证明本文方法具有较高的精度。关键词:几何特征;虹膜模板;虹膜中心;眼动向量特征;注视点22|108|0更新时间:2024-05-07

图像分析和识别

-

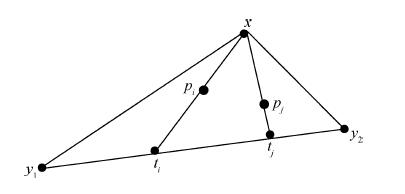

摘要:目的像对稠密匹配是3维重建和SLAM(simultaneous localization and mapping)等高级图像处理的基础,而摄影基线过宽、重复纹理、非刚性形变和时空效率低下等问题是影响这类方法实用性的主要因素,为了更好地解决这类问题,本文提出一种面向重复纹理及非刚性形变的高效稠密匹配方法。方法首先,采用DeepMatching算法获得降采样后像对的匹配点集,并采用随机抽样一致算法剔除其中外点。其次,利用上一步得到的匹配结果估计相机位姿及缩放比例,以确定每个点对稠密化过程中的邻域,再对相应点对的邻域提取HOG描述符并进行卷积操作得到分数矩阵。最后,根据归一化后分数矩阵的数值以及下标距离的方差确定新的匹配点对以实现稠密化。结果在多个公共数据集上采用相同大小且宽高比为4:3的像对进行实验,实验结果表明,本文方法具备一定的抗旋转、尺度变化与形变的能力,能够较好地完成宽基线条件下具有重复纹理及非刚性形变像对的匹配。与DeepMatching算法进行对比实验,本文方法在查准率、空间效率和时间效率上分别提高了近10%、25%和30%。结论本文提出的稠密匹配方法具有较高的查准率和时空效率,其结果可以运用于3维重建和超分辨率重建等高级图像处理技术中。关键词:稠密匹配;非刚体;重复纹理;宽基线;方向梯度直方图17|9|0更新时间:2024-05-07

摘要:目的像对稠密匹配是3维重建和SLAM(simultaneous localization and mapping)等高级图像处理的基础,而摄影基线过宽、重复纹理、非刚性形变和时空效率低下等问题是影响这类方法实用性的主要因素,为了更好地解决这类问题,本文提出一种面向重复纹理及非刚性形变的高效稠密匹配方法。方法首先,采用DeepMatching算法获得降采样后像对的匹配点集,并采用随机抽样一致算法剔除其中外点。其次,利用上一步得到的匹配结果估计相机位姿及缩放比例,以确定每个点对稠密化过程中的邻域,再对相应点对的邻域提取HOG描述符并进行卷积操作得到分数矩阵。最后,根据归一化后分数矩阵的数值以及下标距离的方差确定新的匹配点对以实现稠密化。结果在多个公共数据集上采用相同大小且宽高比为4:3的像对进行实验,实验结果表明,本文方法具备一定的抗旋转、尺度变化与形变的能力,能够较好地完成宽基线条件下具有重复纹理及非刚性形变像对的匹配。与DeepMatching算法进行对比实验,本文方法在查准率、空间效率和时间效率上分别提高了近10%、25%和30%。结论本文提出的稠密匹配方法具有较高的查准率和时空效率,其结果可以运用于3维重建和超分辨率重建等高级图像处理技术中。关键词:稠密匹配;非刚体;重复纹理;宽基线;方向梯度直方图17|9|0更新时间:2024-05-07 -

摘要:目的针对矩形件无约束2维剪切排样问题,提出一种可简化板材切割工艺的简单块占角排样方式,并构造这种排样方式的动态规划生成算法。方法该排样方式在板材左下角按照简单块方式排样若干行若干列同种矩形件,将板材剩余部分划分为两个子板;将子板按照上述方法继续递归排样和划分,直至子板排满矩形件为止。采用动态规划确定所有可能尺寸的板材左下角排样的最优矩形件、矩形件的最优行列数和板材剩余部分的最优子板划分。运用规范尺寸排除不必要的计算。结果将本文算法与目前常见的算法进行比较,实验结果表明本文算法计算时间合理,排样价值较高。在第1组41道基准例题中,本文算法所有例题均求出了精确解,同质块T型算法、同质块两段算法和复合条带两段算法分别有7道、5道和4道例题未求出精确解。在第2组20道基准例题中,本文算法只有1道例题未求出精确解,普通三阶段算法、同质块T型算法、同质块两段算法和匀质条带三块算法分别有18道、15道、15道和20道例题未求出精确解。在第3组50道随机例题中,本文算法、普通两段算法和同质块两段算法板材利用率分别为99.913 7%、99.862 3%和99.796 1%。在第4组31道基准例题中,本文算法所有例题均求出了精确解,普通占角排样算法有2道例题未求出精确解。结论本文算法计算时间远小于精确算法,优化效果接近精确算法;本文算法计算时间与多种启发式算法接近,但优化效果好于多种启发式算法。关键词:无约束2维剪切排样;排样算法;占角排样方式;动态规划;规范尺寸20|8|2更新时间:2024-05-07

摘要:目的针对矩形件无约束2维剪切排样问题,提出一种可简化板材切割工艺的简单块占角排样方式,并构造这种排样方式的动态规划生成算法。方法该排样方式在板材左下角按照简单块方式排样若干行若干列同种矩形件,将板材剩余部分划分为两个子板;将子板按照上述方法继续递归排样和划分,直至子板排满矩形件为止。采用动态规划确定所有可能尺寸的板材左下角排样的最优矩形件、矩形件的最优行列数和板材剩余部分的最优子板划分。运用规范尺寸排除不必要的计算。结果将本文算法与目前常见的算法进行比较,实验结果表明本文算法计算时间合理,排样价值较高。在第1组41道基准例题中,本文算法所有例题均求出了精确解,同质块T型算法、同质块两段算法和复合条带两段算法分别有7道、5道和4道例题未求出精确解。在第2组20道基准例题中,本文算法只有1道例题未求出精确解,普通三阶段算法、同质块T型算法、同质块两段算法和匀质条带三块算法分别有18道、15道、15道和20道例题未求出精确解。在第3组50道随机例题中,本文算法、普通两段算法和同质块两段算法板材利用率分别为99.913 7%、99.862 3%和99.796 1%。在第4组31道基准例题中,本文算法所有例题均求出了精确解,普通占角排样算法有2道例题未求出精确解。结论本文算法计算时间远小于精确算法,优化效果接近精确算法;本文算法计算时间与多种启发式算法接近,但优化效果好于多种启发式算法。关键词:无约束2维剪切排样;排样算法;占角排样方式;动态规划;规范尺寸20|8|2更新时间:2024-05-07

图像理解和计算机视觉

-

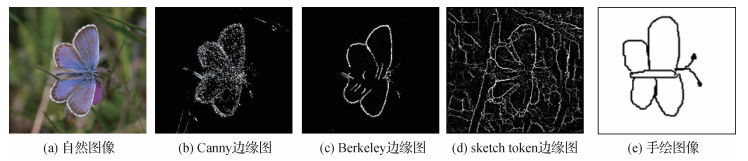

摘要:目的传统的手绘图像检索方法主要集中在检索相同类别的图像,忽略了手绘图像的细粒度特征。对此,提出了一种新的结合细粒度特征与深度卷积网络的手绘图像检索方法,既注重通过深度跨域实现整体匹配,也实现细粒度细节匹配。方法首先构建多通道混合卷积神经网络,对手绘图像和自然图像分别进行不同的处理;其次通过在网络中加入注意力模型来获取细粒度特征;最后将粗细特征融合,进行相似性度量,得到检索结果。结果在不同的数据库上进行实验,与传统的尺度不变特征(SIFT)、方向梯度直方图(HOG)和深度手绘模型Deep SaN(sketch-a-net)、Deep 3DS(sketch)、Deep TSN(triplet sketch net)等5种基准方法进行比较,选取了Top-1和Top-10,在鞋子数据集上,本文方法Top-1正确率提升了12%,在椅子数据集上,本文方法Top-1正确率提升了11%,Top-10提升了3%,与传统的手绘检索方法相比,本文方法得到了更高的准确率。在实验中,本文方法通过手绘图像能在第1幅检索出绝大多数的目标图像,达到了实例级别手绘检索的目的。结论提出了一种新的手绘图像检索方法,为手绘图像和自然图像的跨域检索提供了一种新思路,进行实例级别的手绘检索,与原有的方法相比,检索精度得到明显提升,证明了本文方法的可行性。关键词:手绘图像检索;卷积神经网络;注意力模型;细粒度特征;特征融合16|7|0更新时间:2024-05-07

摘要:目的传统的手绘图像检索方法主要集中在检索相同类别的图像,忽略了手绘图像的细粒度特征。对此,提出了一种新的结合细粒度特征与深度卷积网络的手绘图像检索方法,既注重通过深度跨域实现整体匹配,也实现细粒度细节匹配。方法首先构建多通道混合卷积神经网络,对手绘图像和自然图像分别进行不同的处理;其次通过在网络中加入注意力模型来获取细粒度特征;最后将粗细特征融合,进行相似性度量,得到检索结果。结果在不同的数据库上进行实验,与传统的尺度不变特征(SIFT)、方向梯度直方图(HOG)和深度手绘模型Deep SaN(sketch-a-net)、Deep 3DS(sketch)、Deep TSN(triplet sketch net)等5种基准方法进行比较,选取了Top-1和Top-10,在鞋子数据集上,本文方法Top-1正确率提升了12%,在椅子数据集上,本文方法Top-1正确率提升了11%,Top-10提升了3%,与传统的手绘检索方法相比,本文方法得到了更高的准确率。在实验中,本文方法通过手绘图像能在第1幅检索出绝大多数的目标图像,达到了实例级别手绘检索的目的。结论提出了一种新的手绘图像检索方法,为手绘图像和自然图像的跨域检索提供了一种新思路,进行实例级别的手绘检索,与原有的方法相比,检索精度得到明显提升,证明了本文方法的可行性。关键词:手绘图像检索;卷积神经网络;注意力模型;细粒度特征;特征融合16|7|0更新时间:2024-05-07 -

摘要:目的平行坐标是经典的多维数据可视化方法,但在用于地理空间多维数据分析时,往往存在空间位置信息缺失和空间关联分析不确定等问题。对此,本文设计了一种有效关联平行坐标和地图的地理空间多维数据可视分析方法。方法根据多维属性信息对地理空间位置进行聚类分析,引入Voronoi图和颜色明暗映射对地理空间各类区域进行显著标识,利用平行坐标呈现地理空间多维属性信息,引入互信息度量地理空间聚类与属性类别的相关性,动态地确定平行坐标轴排列顺序,进一步计算属性轴与地图之间数据线的绑定位置,对数据线的布局进行优化处理,降低地图与平行坐标系间数据线分布的紊乱程度。结果有效集成上述可视化设计及数据分析方法,设计与实现一种基于平行坐标轴动态排列的地理空间多维数据可视化分析系统,提供便捷的用户交互模式,通过2组具有明显地理空间多维属性特征的数据进行测试,验证了本文可视分析方法的有效性和实用性。结论本文提出的可视分析方法和工具可以帮助用户快速分析地理空间多维属性存在的空间分布特征及其关联模式,为地理空间多维数据的探索提供了有效手段。关键词:可视分析;地理空间;多维数据;平行坐标;互信息16|8|2更新时间:2024-05-07

摘要:目的平行坐标是经典的多维数据可视化方法,但在用于地理空间多维数据分析时,往往存在空间位置信息缺失和空间关联分析不确定等问题。对此,本文设计了一种有效关联平行坐标和地图的地理空间多维数据可视分析方法。方法根据多维属性信息对地理空间位置进行聚类分析,引入Voronoi图和颜色明暗映射对地理空间各类区域进行显著标识,利用平行坐标呈现地理空间多维属性信息,引入互信息度量地理空间聚类与属性类别的相关性,动态地确定平行坐标轴排列顺序,进一步计算属性轴与地图之间数据线的绑定位置,对数据线的布局进行优化处理,降低地图与平行坐标系间数据线分布的紊乱程度。结果有效集成上述可视化设计及数据分析方法,设计与实现一种基于平行坐标轴动态排列的地理空间多维数据可视化分析系统,提供便捷的用户交互模式,通过2组具有明显地理空间多维属性特征的数据进行测试,验证了本文可视分析方法的有效性和实用性。结论本文提出的可视分析方法和工具可以帮助用户快速分析地理空间多维属性存在的空间分布特征及其关联模式,为地理空间多维数据的探索提供了有效手段。关键词:可视分析;地理空间;多维数据;平行坐标;互信息16|8|2更新时间:2024-05-07 -

摘要:目的基于现有的研究提出一种细节感知的纹理去除算法,在去除图像纹理时,能够很好地保持图像的结构信息,尤其是诸如细长结构和边角信息等在其他方法中容易被模糊化的特殊细节。方法首先,本文提出一种能够识别细长结构的结构检测方法,对细长结构进行检测并增强其结构特征。其次,为了估计每个像素点的最优滤波核尺度,改进原有的相对总变差模型,多方向寻找最小相对总变差,使它能够更好地区分纹理和边界,并且将边角信息从纹理中区分出来。然后,将检测出来的细长结构归一到改进的相对总变差的度量尺度上,估计滤波核尺度,生成引导滤波图像。这样就能够在平坦或有纹理的区域运用大尺度的滤波核,并在结构边缘和边角附近减小滤波核。最后,通过联合双边滤波器得到纹理去除后的图像。结果实验测试了马赛克图像和艺术画作,对比了相对总变差和尺度敏感的结构保护滤波等方法,本文方法在去除纹理的同时保留了细长结构和边角细节,并且具有良好的普适性和鲁棒性。利用本文算法处理一幅含10万像素的图像,仅通过一次迭代计算就能够去除大量纹理且效果优于已有的方法,本算法的计算时间为3.37 s,其他算法为0.07~3.29 s。结论本文设计的纹理滤波器不仅在保持诸如细长结构方面的性能更好,而且使纹理去除后的图像在边角细节处更尖锐,为图像的后续处理提供了一种强有力的图像预处理方式。关键词:纹理滤波;细长结构;结构检测;边缘保持;双边滤波16|8|1更新时间:2024-05-07

摘要:目的基于现有的研究提出一种细节感知的纹理去除算法,在去除图像纹理时,能够很好地保持图像的结构信息,尤其是诸如细长结构和边角信息等在其他方法中容易被模糊化的特殊细节。方法首先,本文提出一种能够识别细长结构的结构检测方法,对细长结构进行检测并增强其结构特征。其次,为了估计每个像素点的最优滤波核尺度,改进原有的相对总变差模型,多方向寻找最小相对总变差,使它能够更好地区分纹理和边界,并且将边角信息从纹理中区分出来。然后,将检测出来的细长结构归一到改进的相对总变差的度量尺度上,估计滤波核尺度,生成引导滤波图像。这样就能够在平坦或有纹理的区域运用大尺度的滤波核,并在结构边缘和边角附近减小滤波核。最后,通过联合双边滤波器得到纹理去除后的图像。结果实验测试了马赛克图像和艺术画作,对比了相对总变差和尺度敏感的结构保护滤波等方法,本文方法在去除纹理的同时保留了细长结构和边角细节,并且具有良好的普适性和鲁棒性。利用本文算法处理一幅含10万像素的图像,仅通过一次迭代计算就能够去除大量纹理且效果优于已有的方法,本算法的计算时间为3.37 s,其他算法为0.07~3.29 s。结论本文设计的纹理滤波器不仅在保持诸如细长结构方面的性能更好,而且使纹理去除后的图像在边角细节处更尖锐,为图像的后续处理提供了一种强有力的图像预处理方式。关键词:纹理滤波;细长结构;结构检测;边缘保持;双边滤波16|8|1更新时间:2024-05-07 -

摘要:目的针对现有服装搭配系统中,提取服装图像深度特征进行搭配所需时间过长的问题,提出了一种新的FMatchNet网络提取哈希特征进行服装快速搭配的方法。方法首先采用快速区域卷积神经网络(Faster-RCNN)方法检测出图像中的服装,用此服装进行搭配可以最大限度地保留服装信息并消除背景信息的干扰。然后用深度卷积神经网络提取服装的深度特征并产生服装的哈希码,采用查询扩展的方法完成服装搭配。模型采用Siamese网络的训练方法使哈希码尽可能保留服装图像的语义信息。另外,由于目前国际上缺少大型时尚服装数据库,本文扩建了一个细粒度标注的时尚服装数据库。结果在FClothes数据库上验证本文方法并与目前流行的方法进行对比,本文方法在哈希长度为16时,上、下服装搭配方面的准确度达到了50.81%,搭配速度相对于基本准线算法提高了近3倍。结论针对大规模服装搭配问题,提出一种新的FMatchNet网络提取特征进行服装快速搭配的方法,提高了服装搭配的精度和速度,适用于日常服装搭配。关键词:服装搭配;Siamese网络;哈希;查询扩展;Faster-RCNN23|9|1更新时间:2024-05-07

摘要:目的针对现有服装搭配系统中,提取服装图像深度特征进行搭配所需时间过长的问题,提出了一种新的FMatchNet网络提取哈希特征进行服装快速搭配的方法。方法首先采用快速区域卷积神经网络(Faster-RCNN)方法检测出图像中的服装,用此服装进行搭配可以最大限度地保留服装信息并消除背景信息的干扰。然后用深度卷积神经网络提取服装的深度特征并产生服装的哈希码,采用查询扩展的方法完成服装搭配。模型采用Siamese网络的训练方法使哈希码尽可能保留服装图像的语义信息。另外,由于目前国际上缺少大型时尚服装数据库,本文扩建了一个细粒度标注的时尚服装数据库。结果在FClothes数据库上验证本文方法并与目前流行的方法进行对比,本文方法在哈希长度为16时,上、下服装搭配方面的准确度达到了50.81%,搭配速度相对于基本准线算法提高了近3倍。结论针对大规模服装搭配问题,提出一种新的FMatchNet网络提取特征进行服装快速搭配的方法,提高了服装搭配的精度和速度,适用于日常服装搭配。关键词:服装搭配;Siamese网络;哈希;查询扩展;Faster-RCNN23|9|1更新时间:2024-05-07 -

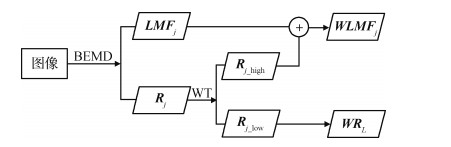

摘要:目的针对传统的基于多尺度变换的图像融合算法的不足,提出了一种基于W变换和2维经验模态分解(BEMD)的红外与可见光图像融合算法。方法首先,为了更有效地提取图像的高频信息,抑制BEMD中存在的模态混叠现象,提出了一种基于W变换和BEMD的新的多尺度分解算法(简称W-BEMD);然后,利用W-BEMD对源图像进行塔式分解,获得图像的高频分量WIMFs和残差分量WR;接着,对源图像对应的WIMFs分量和WR分量分别采用基于局部区域方差选择与加权和基于局部区域能量选择与加权的融合规则进行融合,得到融合图像的W-BEMD分解;最后,通过W-BEMD逆变换得到最终融合图像。W-BEMD分解算法的主要思想是通过W变换递归地将BEMD分解过程中每层所得低频分量中滞留的高频成分提取出来并叠加到相应的高频分量中,实现更有效的图像多尺度分解。结果对比实验结果表明,本文方法得到的融合图像视觉效果更佳,既有突出的红外目标,又有清晰的可见光背景细节,而且在平均梯度(AG)、空间频率(SF)、互信息(MI)3个客观评价指标上也有显著优势。结论本文提出了一种新的红外与可见光图像融合算法,实验结果表明,该算法具有较好的融合效果,在保留可见光图像中的细节信息和突出红外图像中的目标信息方面更加有效。关键词:红外图像;可见光图像;W变换;2维经验模态分解(BEMD);W-BEMD多尺度分解算法;图像融合21|12|6更新时间:2024-05-07

摘要:目的针对传统的基于多尺度变换的图像融合算法的不足,提出了一种基于W变换和2维经验模态分解(BEMD)的红外与可见光图像融合算法。方法首先,为了更有效地提取图像的高频信息,抑制BEMD中存在的模态混叠现象,提出了一种基于W变换和BEMD的新的多尺度分解算法(简称W-BEMD);然后,利用W-BEMD对源图像进行塔式分解,获得图像的高频分量WIMFs和残差分量WR;接着,对源图像对应的WIMFs分量和WR分量分别采用基于局部区域方差选择与加权和基于局部区域能量选择与加权的融合规则进行融合,得到融合图像的W-BEMD分解;最后,通过W-BEMD逆变换得到最终融合图像。W-BEMD分解算法的主要思想是通过W变换递归地将BEMD分解过程中每层所得低频分量中滞留的高频成分提取出来并叠加到相应的高频分量中,实现更有效的图像多尺度分解。结果对比实验结果表明,本文方法得到的融合图像视觉效果更佳,既有突出的红外目标,又有清晰的可见光背景细节,而且在平均梯度(AG)、空间频率(SF)、互信息(MI)3个客观评价指标上也有显著优势。结论本文提出了一种新的红外与可见光图像融合算法,实验结果表明,该算法具有较好的融合效果,在保留可见光图像中的细节信息和突出红外图像中的目标信息方面更加有效。关键词:红外图像;可见光图像;W变换;2维经验模态分解(BEMD);W-BEMD多尺度分解算法;图像融合21|12|6更新时间:2024-05-07 -

摘要:目的在柔性密封条误差测量过程中,密封条容易弯曲且形变较大,直接匹配精度较低,测量误差大。针对此问题,提出了一种新的柔性密封条截面误差自动视觉测量方法。方法通过两步图像轮廓配准来获取测量图段和设计图段之间的匹配关系,然后进行误差度量和质量检验。1)通过基于多分辨率的轮廓角点提取算法提取出密封条轮廓的角点,然后基于最小化均方误差的思想进行穷举搜索,计算初始配准结果,再使用线性回归进行微调进一步提高初始配准结果;2)利用形状描述子进行局部轮廓配准,进一步获得两张轮廓图之间的精确局部配准结果;3)进行不同类型的误差定量计算和结果对比,主要测量的误差类型包括点偏移误差、点极限距离误差和角度位置误差等形位误差。结果对密封条进行了逐步轮廓配准和多种误差测量,并在实际生产中进行了测试。实验结果表明,该系统配准结果好,测量精度高。该系统测量精度远高于密封条测量系统精度标准0.2 mm,且系统检测结果与实际人工检测结果完全一致,能有效促进柔性密封条自动化检测的发展。结论提出了一种新的柔性密封条截面误差自动视觉测量方法,该系统具有良好的稳定性和可靠性,能有效进行柔性产品误差测量和质量检验。关键词:视觉测量;密封条;图像配准;误差;角点检测14|7|0更新时间:2024-05-07

摘要:目的在柔性密封条误差测量过程中,密封条容易弯曲且形变较大,直接匹配精度较低,测量误差大。针对此问题,提出了一种新的柔性密封条截面误差自动视觉测量方法。方法通过两步图像轮廓配准来获取测量图段和设计图段之间的匹配关系,然后进行误差度量和质量检验。1)通过基于多分辨率的轮廓角点提取算法提取出密封条轮廓的角点,然后基于最小化均方误差的思想进行穷举搜索,计算初始配准结果,再使用线性回归进行微调进一步提高初始配准结果;2)利用形状描述子进行局部轮廓配准,进一步获得两张轮廓图之间的精确局部配准结果;3)进行不同类型的误差定量计算和结果对比,主要测量的误差类型包括点偏移误差、点极限距离误差和角度位置误差等形位误差。结果对密封条进行了逐步轮廓配准和多种误差测量,并在实际生产中进行了测试。实验结果表明,该系统配准结果好,测量精度高。该系统测量精度远高于密封条测量系统精度标准0.2 mm,且系统检测结果与实际人工检测结果完全一致,能有效促进柔性密封条自动化检测的发展。结论提出了一种新的柔性密封条截面误差自动视觉测量方法,该系统具有良好的稳定性和可靠性,能有效进行柔性产品误差测量和质量检验。关键词:视觉测量;密封条;图像配准;误差;角点检测14|7|0更新时间:2024-05-07

Chinagraph 2018

0